曼昆研究 | 律师如何用OpenClaw搭建合规工作流

在AI浪潮中,律师如何在不违反保密义务的前提下,真正用上AI? 客户合同不能直接粘贴到ChatGPT里,否则可能面临纪律处分?本文从律师保密义务、注意事项、AI服务商的选择等角度,介绍下我的配置。

律师的保密义务

1. 中国:《律师法》第三十三条

首先是大家耳熟能详的《中华人民共和国律师法》第三十三条,其中规定:

“律师应当保守在执业活动中知悉的国家秘密、商业秘密,不得泄露当事人的隐私。律师对在执业活动中知悉的委托人和其他人不愿泄露的有关情况和信息,应当予以保密。”

中国律师法的保密义务上升到了刑事责任层面。《刑法》第三百零九条规定了泄露不应公开的案件信息罪。此外,《律师执业管理办法》第三十八条也明确禁止律师泄露在执业中知悉的商业秘密和个人隐私。

目前,各地方律协及司法部对于律师使用生成式人工智能还没有更细化的指引。因此,我们可以参考下美国同行的要求。

2. 美国:ABA Model Rule 1.6与NY RPC Rule 1.6

如果持有纽约州律师执照(或任何美国州的执照),律师对客户信息的保密义务不仅仅是一种职业道德,更是一条可执行的纪律规则。

纽约州职业行为准则第1.6条(NY RPC Rule 1.6) 规定:

"A lawyer shall not knowingly reveal confidential information... unless the client gives informed consent."

这里的“confidential information”范围极广——不限于法庭秘密,而是涵盖律师在代理过程中获知的一切信息,包括客户姓名、地址、财务数据、交易条款、商业策略,不论信息来源。

更关键的是Rule 1.6(c):

"A lawyer shall make reasonable efforts to prevent the inadvertent or unauthorized disclosure of, or unauthorized access to, information relating to the representation of a client."

这意味着:我们不仅不能主动泄露客户信息,还必须采取合理措施防止泄露。

2024年7月,ABA正式发布了Formal Opinion 512——这是美国律师界第一份针对生成式AI使用的综合性伦理指引。该意见明确指出:

在将与客户代理相关的信息输入(生成式AI)工具之前,律师必须评估该信息被“披露给或被”工具内外其他个人访问的可能性。

Opinion 512将AI工具类比为云计算服务,要求律师必须:

调查所使用AI工具的可靠性、安全措施和数据处理政策

确保工具的配置能保护保密性和安全性

确认保密义务具有可执行性(如合同约束)

监控是否存在违规或提供商政策变更

简单来说:我们不能把客户合同直接粘贴到ChatGPT里,除非我们做了充分的合规评估。

这意味着,无论我们执业于哪个法域,保密义务都是不可逾越的底线。

3. 为什么AI让保密义务变得更复杂?

当我们在消费级AI应用(ChatGPT、Claude、Kimi等)中输入客户合同时,该文本会被传输至第三方服务器。即使提供商声称不会使用数据训练模型,仍然存在以下风险:

数据传输:客户PII(个人身份信息)离开我们的控制,进入第三方基础设施

训练风险:消费级产品可能将输入用于模型训练(需仔细核查服务协议)

违规暴露:我们现在依赖提供商的安全措施来履行我们自己的伦理义务

审计缺口:我们无法验证数据传输后发生了什么

知情同意:为每次AI交互获取客户同意在实践中不可行

大多数律师的应对方式要么是完全不用AI(丧失竞争优势),要么是“用了再说”(冒着纪律处分的风险)。两者都不是好答案。我将在第三节详细讲述需要注意的相关事项。

OpenClaw:如何开始第一步?

1. 什么是OpenClaw?

OpenClaw是一个开源的多智能体(multi-agent)AI助手平台。简单来说,它是一个运行在我们自己硬件上的“AI网关”,可以同时管理多个AI助手(agent),每个助手有独立的角色、记忆和工具。

2. 核心功能

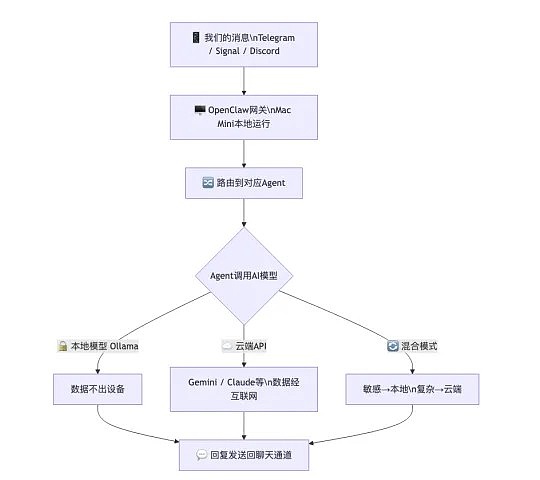

3. 它是如何工作的?

OpenClaw作为一个“网关”运行在我们的本地设备上:

OpenClaw本身是免费开源的,但我们需要:

一台运行设备。

你不用的电脑、Mac Mini都可以。但我更推荐使用Mac,主要是因为目前的OpenClaw生态大多是围绕这Mac/Linux搭建,虽然也有很多人在开发windows版本,但现阶段Mac会更稳定。

阿里云、腾讯云等服务商租一个VPS。最近Kimi官方还推出了一键部署的OpenClaw,如果想低成本试用OpenClaw,可以先从这个开始。

AI模型的API密钥(如使用云端模型)

可以选择从LLM云服务商那里直接购买,比如Google Gemini、阿里云、月之暗面等等。从开发商购买API,除了价格之外,还有一个优势就是有一些云服务商会提供Batch API. 既对于一些大量、但不急的任务,云服务商提供50%的折扣,换取24小时之后再给你答案。

第二个选择是大模型聚合平台(LLM Aggregator),比如OpenRouter, 硅基流动。这种云服务商的优势在于统一接口、提供多种LLM的选择,并且搭载路由功能,可以设置自动转换不同的LLM.

或本地安装Ollama+开源模型(如不想依赖云端),这个就可以根据你的主机配置自由选择,丰俭由人。

4. 为什么我用Mac Mini?

本地运行和生产环境隔离:一台独立的电脑可以确保OpenClaw不会发癫删掉我重要的工作文件。当然,租用一个VPS也可以起到物理隔离的目的。但是VPS通常是Linux系统,且在云端,使用体验不如本地丝滑。对于一些需要优良网络环境的任务,VPS还是不错的选择。而且租用的VPS通常配置不高,如需租用高配置,价格也不便宜。

Apple Silicon统一内存:M4芯片的统一内存架构让大型AI模型可以直接加载到内存中运行,无需昂贵的GPU. 统一内存架构让window中常见的显存+闪存合二为一。这样在运行大模型的时候,可以灵活调用,比单独买显卡要便宜。

32GB内存:足以运行35B参数的MoE模型(如Qwen 3.5 35B),推理速度约18 tokens/秒

功耗极低、体积小巧、噪音极低:Mac Mini待机功耗约5W,满载运行AI模型约15-30W,7×24小时运行一个月电费不到10元。新款Mac Mini仅手掌大小,放在书架上或桌面角落即可。即使满载运行AI模型,噪音极低。

保密工作需要关注什么?

我们在使用OpenClaw或任何AI工具进行法律工作时,需要关注三个层面的保密性。

1. 通讯通道的保密性

我们与AI助手之间的通讯通道是第一道防线。

我建议涉及高度机密的法律工作首先应使用端对端加密软件作为通讯通道。那么有些人问了,平时客户也是用微信和我联系的呀?没错,如果客户首先用微信联系,那么这里有一个implied consent. 即客户同意使用微信作为信息传输信道。如果我们自行将客户机密信息通过非加密渠道传输,那么至少,我们应当先获得客户的书面同意。

2. API提供商的选择:省钱vs.保密

这是最核心也最容易被忽视的问题。

Coding Plan

近年来,国内云厂商推出了极具吸引力的“编程计划”(Coding Plan):以极低的价格提供顶级模型的API访问。

以阿里云百炼为例:

Lite套餐:首月¥7.9,次月¥20,之后¥40/月

Pro套餐:首月¥39.9,次月¥100,之后¥200/月

包含模型:Qwen3.5-Plus、Kimi K2.5、GLM-5、MiniMax M2.5

价格确实诱人。而且订阅制不用担心API花费超标。但请注意百炼Coding Plan的数据政策中这句话:

“使用 Coding Plan 期间,模型输入以及模型生成的内容将用于服务改进与模型优化。”

这意味着:我们输入的所有内容,包括可能包含客户信息的法律文件,都会被用于模型训练和优化。对于律师来说,这直接违反了保密义务。

API选择需要关注的关键信息

既然Coding Plan不能处理机密信息(当然,云服务商推出Coding Plan的目的也不是为了让我们处理机密信息的),直接购买API的token或成为更优选项。选择AI模型API时,律师必须在服务合同中审查以下几点:

各大API提供商对比

需要着重强调的是,即使API提供商声称ZDR且不用于训练,律师仍然无法完全验证这些承诺的执行情况。我相信云服务商不会给我们个人用户开放审查的权限。回到ABA Opinion 512,律师应调查AI工具的安全措施、确认保密的执行情况。如果我们无法审查保密措施的执行情况,那么我认为API并不符合Opinion 512的要求。LLM是一个黑盒,我们无法确认我们的数据在传输后到底发生了什么。

3. 最保险的选择:本地模型

如果我们对保密性有最高要求,本地运行模型是唯一能100%确保数据不泄露的方案。

优点:

• 数据完全不出设备,100%隐私

• 无API费用,无使用限制

• 不依赖网络,随时可用

• 不受提供商政策变更影响

缺点:

• 推理速度较慢(18 tok/s vs 云端100+ tok/s)

• 模型能力弱于前沿云端模型(GPT-4o、Claude Opus等)

• 需要投入硬件成本

• 上下文窗口受内存限制

推荐本地模型:

备注:MoE(Mixture of Experts)是一种模型架构,虽然总参数35B,但每次推理只激活约3B参数,大幅降低了运算量和内存需求。这就是为什么35B的模型能在32GB内存的Mac Mini上流畅运行。

我的配置

鉴于我是一名纽约执业的律师,以下是我依照Opinion 512搭建的OpenClaw的实际配置。

1. 通讯通道

Signal(端到端加密)作为法律工作的主通道。所有与法律Agent(Counsel)的对话都通过Signal进行,确保通讯层面的完全加密。日常非涉密工作通过Telegram进行。

2. 模型配置

我采用混合模型策略:

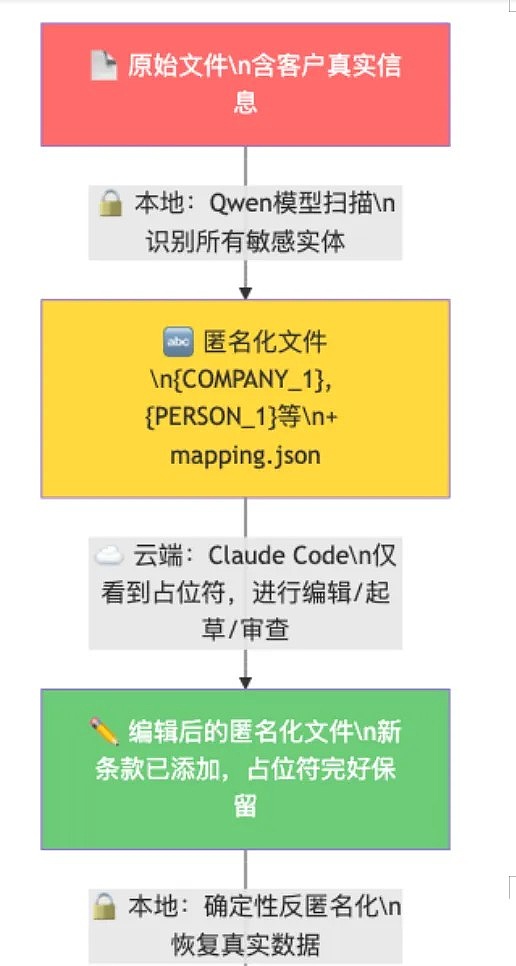

3. 核心安全流程:匿名化管道

这是整个配置中最重要的部分。当我需要用强大的云端AI来起草或审查敏感文件时:

关键点:mapping.json(真实数据与占位符的映射表)永远不会离开我们的设备。云端AI看到的只是“{COMPANY_1}收购{COMPANY_2} 30%股权”——它不知道也无法知道真正的当事方是谁。

4. 为什么选择Claude Code这种消费级AI作为云端编辑工具?

订阅制:Max计划$100/月或$200/月,相比API按量计费更经济

最新最强模型:订阅用户可以直接使用最新发布的模型(如Claude Opus 4)

对比API价格:Claude API输入$3/百万token、输出$15/百万token。一份复杂合同的审查可能消耗数百万token,按量计费下来远超订阅费用。如果价格不是你的考虑因素,那么在加密之后直接用Opus的API会是体验更丝滑的选项,当然价格也会更贵。按照我目前token消耗量来计算,如果全部使用Claude API的话,大概每月需花费500+美元。

这个方案从根本上满足了ABA Formal Opinion 512的所有要求,因为云端AI从未接收过保密信息。

5. 硬件配置

6. 成本计算

对比之下,Harvey AI等企业级法律AI平台的价格为每用户每月$1,000-1,200(约¥7,200-8,600),且通常要求最少20个席位。

7. 开源项目

我将这套配置和工作流开源在GitHub上:

VibeCodingLegalTools(https://github.com/Reytian/VibeCodingLegalTools)—Rule1.6-compliant AI workflow for legal practice

项目包含:

完整的匿名化/反匿名化工具(LDA)

OpenClaw配置模板

Agent工作空间模板

客户记忆系统模板

详细的伦理合规分析

我对法律AI的思考

1. 完全本地化是理想,但目前不现实

在理想世界里,律师应该完全在本地运行AI——所有数据留在自己的设备上,零泄露风险。但现实是:

模型能力差距:本地可运行的模型(35B参数级别)与前沿云端模型(万亿参数级别)之间存在显著的能力差距。对于简单的法律咨询和信息检索,本地模型足够了。但对于复杂的合同起草、多轮法律推理和高质量文本生成,本地模型的表现仍然不够理想。

硬件成本:要运行真正强大的本地模型(如70B+参数),需要64GB甚至更多内存,硬件成本迅速攀升。对于独立执业律师和小型律所来说,经济上不可行。

模型更新滞后:开源模型的更新速度永远慢于商业前沿模型。

2. 完全依赖云端同样有问题

另一方面,完全依赖云端API也不是解决方案:

即使API提供商承诺ZDR(零数据保留)和不用于训练,律师实际上几乎不可能调查任何可疑的泄露。

LLM是一个黑盒。我们无法打开它,检查我们的数据是否被用于训练。我们只能相信提供商的承诺。

而作为律师,“相信”不是一种合规策略。Rule 1.6要求的是“reasonable efforts”——合理的努力,而不是合理的信任。

3. 混合模型是当下最优解

这就是为什么我选择混合模型策略:

1. 日常咨询 → 本地模型:简单的法律问题、信息检索、初步分析,完全在本地完成

2. 复杂任务 → 云端API:需要更强推理能力时使用可信的API,但避免传输敏感信息

3. 敏感文件 → 匿名化管道:需要云端AI处理机密文件时,先在本地匿名化,再交给云端处理,最后本地还原

这个方案的核心思想是:用技术手段(匿名化)弥补信任缺口。我们不需要相信任何AI提供商会妥善保管我们的客户数据,因为他们从未收到过客户数据。

云端AI看到的永远是“{COMPANY_1}”和“{PERSON_1}”,而不是我们客户的真实名字。

结语

AI不会取代律师。但会用AI的律师,终将取代不会用AI的律师。

关键不在于用不用AI,而在于怎么用。保密义务是律师执业的基石,它不应该成为我们拥抱AI的障碍,而应该成为我们选择AI方案的标准。

Legal AI卖的是什么?我认为有两种:

1. 知识;

2. 工具。

我相信各位律师已经有足够的知识了,只是需要个更衬手的工具。当一台Mac Mini的价格还不及Harvey AI一个月订阅费时,自己搭建一套合规工具,或许是独立律师更务实的选择。

一台Mac Mini、一套OpenClaw、一个加密的通信管道,这就是一个合规的AI法律工作站的全部。

本文不构成法律意见。律师应根据其所在法域的具体伦理规则评估本文描述的工作流,并在必要时获取专业的伦理指导。

参考资料:

ABA Model Rules of Professional Conduct, Rule 1.6

ABA Formal Opinion 512 — Generative Artificial Intelligence Tools (2024)

中华人民共和国律师法(2017修订)

OpenClaw (https://openclaw.ai/)

VibeCodingLegalTools—GitHub (https://github.com/Reytian/VibeCodingLegalTools)

原创作者:易浩天

声明:本文系金色财经原创稿件,版权属金色财经所有,未经授权不得转载,已经协议授权的媒体下载使用时须注明"稿件来源:金色财经",违者将依法追究责任。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

美股持续新高 比特币能跟上吗?

美股持续新高 比特币能跟上吗?区块链骑士

那个让Web3最接近AI的人

那个让Web3最接近AI的人链捕手ChainCatcher

付鹏演讲实录:为什么传统金融机构开始入局加密行业

付鹏演讲实录:为什么传统金融机构开始入局加密行业Foresight News

美军承认运行比特币节点

美军承认运行比特币节点W3C DAO

对DeFi的态度:当下谨慎 前途光明

对DeFi的态度:当下谨慎 前途光明道说时间

加密市场宏观研报:停火博弈、美联储换帅与机构化提速

加密市场宏观研报:停火博弈、美联储换帅与机构化提速HTX成长学院专栏

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部