Ark Invest:AI基础设施的现状和未来

来源:Frank Downing,Ark Invest;编译:金色财经Claw

AI基础设施支出呈爆炸式增长

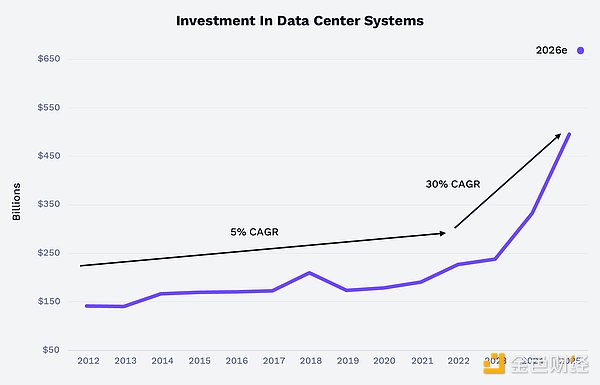

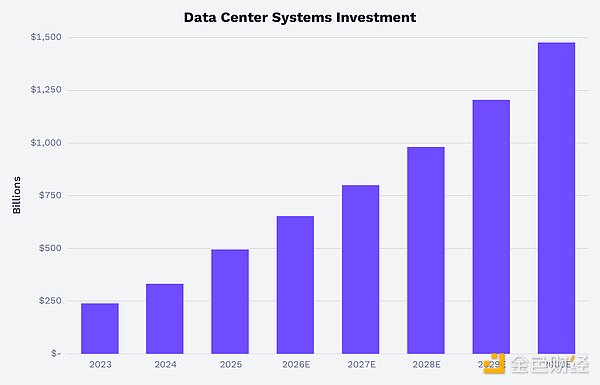

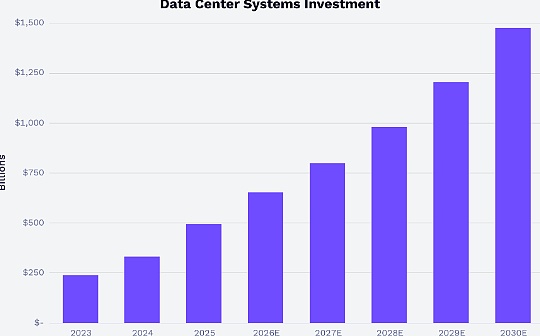

自ChatGPT发布以来的三年间,对加速计算的需求呈爆炸式增长。英伟达的年收入飙升近8倍,从2022年的270亿美元增至2025年的2160亿美元,市场一致预期2026年将再增长62%,达到3500亿美元。全球数据中心系统投资(包括计算、网络和存储硬件)的增速已从截至2022年十年间的年均5%加速至过去三年的30%,预计2026年将再增长超过30%,达到6530亿美元。

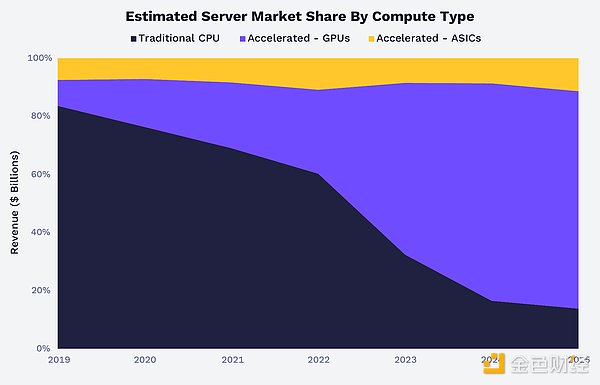

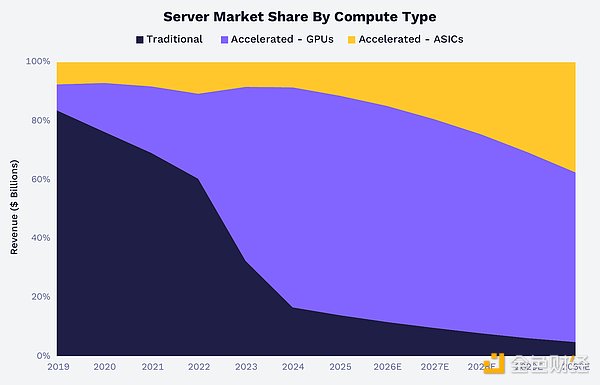

ARK的研究表明,由GPU和AI专用集成电路(ASIC)驱动的加速计算(相对于通用CPU而言)如今已主导服务器投资,占计算服务器销售额的86%。

成本骤降推动采用加速

推动对运行AI模型所需的加速计算基础设施支出持续增加的动力,来自生成式AI在消费端和企业端使用场景的不断扩大,以及在追求"超级智能"过程中训练更智能基础模型的需求。

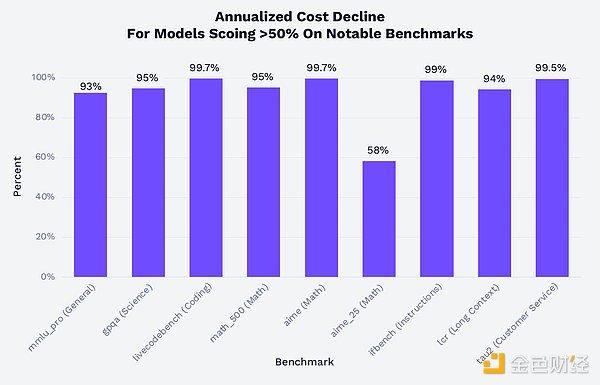

成本的快速下降正在进一步加速需求增长。根据我们的研究,AI训练成本每年下降75%。推理成本下降更快——在Artificial Analysis追踪的基准测试中,评分超过50%的模型,其中位成本年化降幅高达95%。

两股力量共同推动了成本的大幅下降:一是以英伟达为代表的行业领导者每年推出新产品,带来一代代的硬件性能提升;二是软件层面的算法改进,使在相同硬件上进行训练和推理的效率不断提高。

消费者与企业均发出强烈需求信号

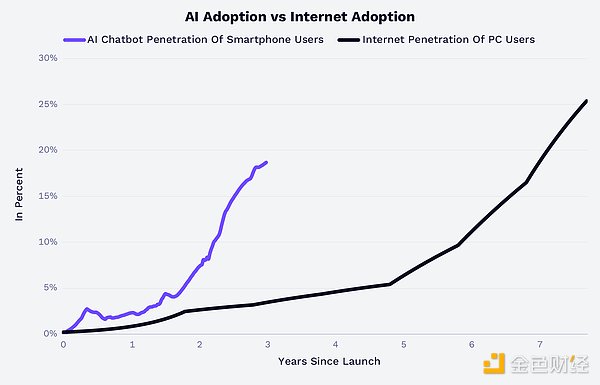

消费者采用AI的速度明显快于当年采用互联网的速度。AI普及率在三年内扩展至约20%,是消费者转向互联网速度的两倍以上。

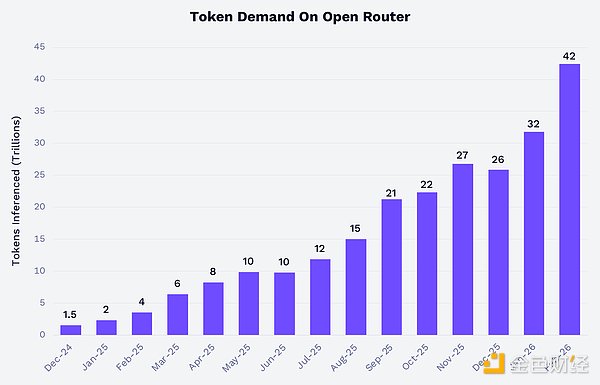

企业需求同样以惊人速度增长。以OpenRouter的数据为例,自2024年12月以来,token需求增长了28倍。

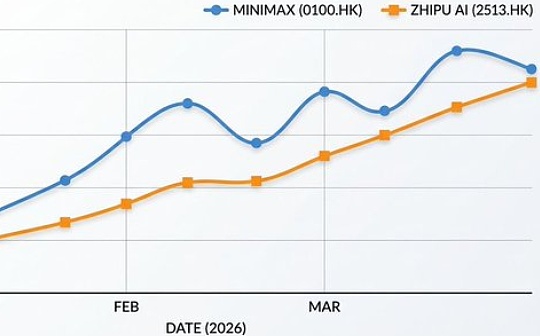

过去两年间,最受企业客户青睐的AI实验室Anthropic实现了约100倍的惊人营收增长——从2023年末年化运营收入的1亿美元,增长至2025年末估计的80亿至100亿美元。Anthropic在2026年的增势仍在延续,今年2月宣布年化收入达到140亿美元,并完成了一轮300亿美元的融资,估值达3800亿美元。

在消费者和企业两条战线同步竞争的OpenAI,在企业用户中同样获得了强劲增长,截至2025年11月已拥有100万企业客户。据首席财务官Sarah Friar介绍,OpenAI的企业营收增速快于消费者业务,预计2026年将占公司总营收的50%。Friar在2026年1月的一篇博客中也阐明了进一步投资基础设施的理由:过去三年,OpenAI的营收与其计算容量呈正比例增长。

私募市场为AI建设提供资金

为满足强劲的需求信号,大规模基础设施投资已成为必要。据Crunchbase数据,2025年私人AI实验室融资超过2000亿美元,其中约800亿美元流向OpenAI、Anthropic和xAI等基础模型开发商。在公开市场,超大规模云计算企业正在动用现金储备,并寻求其他融资方式,以支持其AI资本支出计划——2026年该支出规模可能高达7000亿美元。

据报道,Meta与Blue Owl达成的300亿美元交易是有史以来规模最大的私人资本交易。该交易以合资公司形式构建,主要以债务融资,其特殊目的载体(SPV)结构将使项目债务不体现在Meta的资产负债表上,此举已引发了相当大的争议。

AMD及其他厂商成为英伟达的有力挑战者

在物理数据中心之外,计算芯片一直是AI资本支出的核心。英伟达一直处于加速计算时代的前沿,但如今最大的AI芯片采购方正试图提升每一美元投资所获得的AI算力。自2006年收购ATI Technologies以来,超威半导体(AMD)一直与英伟达并肩在消费市场销售GPU,如今也成为企业市场的新兴竞争者。自2017年推出EPYC系列处理器以来,AMD在服务器CPU市场的份额也从2017年的近乎为零增长至2025年的40%。

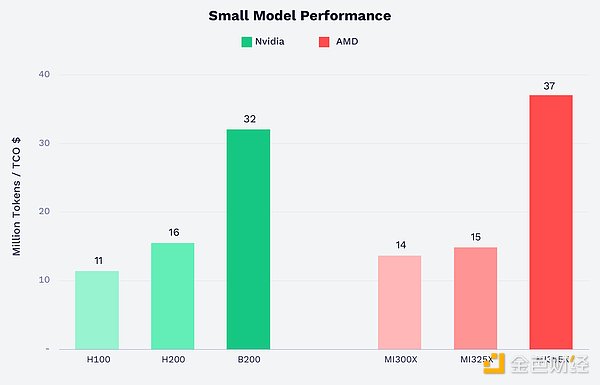

就小型模型推理而言,AMD GPU在总拥有成本(TCO)相对性能上已与英伟达旗鼓相当。TCO同时考虑了芯片的前期购买成本(资本支出)和芯片在使用寿命期间的运营成本(运营支出)。性能基准采用SemiAnalysis的InferenceMax指标,以针对吞吐量优化时每个GPU每秒处理的token数为衡量标准,成本基准则采用SemiAnalysis对每小时资本支出和运营支出的估算。

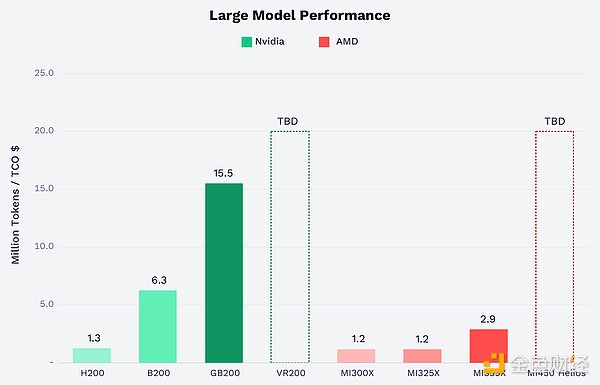

尽管AMD在小型模型性能上已"迎头赶上",英伟达在大型模型性能上仍保持显著领先,见下图。

英伟达的机架级解决方案Grace Blackwell将72个Grace Blackwell GPU(GB200)联网,使其像一块共享内存的超大型GPU一样运行。这种芯片间的紧密互联强化了大型模型的推理能力——大型模型需要将模型权重分布在多个GPU上,比小型模型需要更多的通信带宽。为赶在英伟达Vera Rubin发布前缩小差距,AMD的机架级解决方案计划于2026年下半年上市。迄今为止,AMD已在微软、Meta、OpenAI、xAI和甲骨文等客户处赢得了订单。

超大规模云厂商引领定制芯片革命

除商用GPU供应商外,超大规模云厂商和AI实验室也希望通过自研芯片来控制英伟达的影响力,降低AI计算成本。十余年来,谷歌一直在设计自己的AI专用集成电路——张量处理单元(TPU),用于为其搜索业务运行推荐模型,并在最新一代TPU v7上针对生成式AI进行了性能优化。SemiAnalysis估计,谷歌通过自研TPU处理内部工作负载,每次计算的成本相比英伟达可降低62%。Anthropic和Meta正在使用谷歌的TPU扩展其计算能力,这或许印证了62%的估算与实际情况相差不远。

亚马逊的Trainium芯片似乎是次先进的解决方案。2015年收购Annapurna Labs后,亚马逊率先为其云业务开发定制芯片,将基于ARM架构的Graviton CPU和Nitro数据处理单元(DPU)扩展,为亚马逊云科技(AWS)的重要算力提供支撑。亚马逊近期宣布,2025年Graviton已连续第三年提供了AWS新增CPU算力的一半以上。除使用TPU外,Anthropic还将AWS和Trainium作为其首选训练平台。

微软在2023年才后发制人进入定制芯片领域,发布了AI加速器Maia 100,但当时并未聚焦生成式AI,目前其第二代产品正在推出,主攻AI推理场景。

博通主导定制芯片服务市场

谷歌和亚马逊专注于前端芯片设计(架构与功能),而后端设计合作伙伴则负责将其逻辑转化为硅片、管理先进封装,并与台积电等晶圆代工厂协调生产。在英特尔晶圆代工业务遭遇挑战的背景下,台积电已成为大多数主要AI芯片项目的首选合作伙伴,而博通则成为谷歌TPU、Meta MTIA以及OpenAI即将于2026年推出的定制芯片的领先后端设计合作伙伴。苹果一向亲力亲为地完成其手机和PC芯片的全流程设计,但有报道称其也可能正在与博通合作开发AI芯片。花旗预测,博通的AI营收在未来两年内可能增长五倍,从2025年的200亿美元增至2027年的1000亿美元。

亚马逊Trainium的研发路径在同行中颇为特殊——据报道,Trainium 2与Marvell合作,随后因Marvell执行不力,Trainium 3和Trainium 4转而与Alchip合作。亚马逊能够更换后端合作伙伴,说明垂直整合对博通这样的公司而言确实存在一定风险。值得注意的是,苹果和特斯拉直接与晶圆代工厂合作。谷歌在其TPU v8上可能也会如此——该产品有两个SKU,一个由博通联合设计,另一个则由谷歌在MediaTek支持下自主设计和掌控。

芯片初创公司活动升温

我们的研究表明,一批尝试新架构范式的初创公司构成的长尾力量,可能进一步挑战现有芯片厂商的市场地位。Cerebras以其晶圆级引擎(一块由单片硅晶圆制成、大小如披萨盒的巨型芯片)而闻名,提供市场上最快的每秒token处理速度,据报道正计划今年上市。该公司近期宣布与OpenAI合作推出高速编程模型Codex Spark,此前双方于今年1月已达成合作协议。Groq同样凭借每秒token处理速度的卓越表现,近期与英伟达签署了一项价值200亿美元的非独家知识产权许可协议,其中包括Groq 90%的员工,以及CEO兼TPU联合创始人Jonathan Ross。这实际上是对Groq团队和技术的一次收购,这种交易结构在并购市场日益流行,因为科技巨头希望借此规避监管审查带来的延误。在其他收购动态方面,英特尔最近在据报道收购谈判失败后转而与SambaNova建立合作关系。英特尔自2014年起在AI领域进行了四次收购,却始终未能推出广受市场认可的AI产品,这一记录颇为令人唏嘘。

展望未来:2030年规模将达1.4万亿美元

根据我们的研究,未来五年需求的持续增长和性能的不断提升将推动AI软件和云服务的发展,AI基础设施支出将在未来五年实现三倍增长——从2025年的5000亿美元增至2030年的近1.5万亿美元。

我们的预测基于对数据中心系统投资相对于软件营收的历史观察。2010年代初期,随着云计算的兴起,系统投资约占全球软件支出的50%。到2021年,新冠疫情后的过度投资和客户优化使系统投资相对软件支出的比例降至20%出头的低位。我们1.5万亿美元的预测假设2030年投资额为我们对全球软件支出中性预测情景(即2030年7万亿美元)的20%,这一比例我们在去年的一篇博客中已有详细阐述。我们认为20%的水平已充分考虑了2030年前潜在的过度投资风险,以及软件营收增速慢于中性预测情景的可能性——在后一种情况下,我们认为基础设施投资将继续保持高速增长,正如2010年代初期的情形一样。

随着AI驱动的算力需求持续增长,我们预计定制芯片在计算支出中的占比将不断提升——因为设计针对特定工作负载芯片所需的时间和资金投入,将在规模化时体现出越来越重要的每美元性能优势。我们认为,到2030年,定制ASIC在计算市场的占比可能超过三分之一。

综合来看,我们的研究表明,当前正在进行的基础设施建设并非一个即将破裂的泡沫,而是一次千载难逢的平台级变革的基础。ARK预测2030年AI基础设施年支出将接近1.5万亿美元,这一市场由来自消费者和企业的真实且持续加速的需求驱动,而不断下降的成本也在持续验证和释放新的使用场景。我们相信,在未来五年中脱颖而出的企业,将是那些能够设计出最高效芯片、构建最强大模型、并将二者大规模部署落地的企业。

正如英伟达CEO黄仁勋在2026财年第四季度财报电话会议上所阐述的那样,真正实用的AI智能体在过去数月间才刚刚开始大规模落地。它们对token的消耗量巨大,但能力远超大多数用户此前所习惯的AI产品。将这些智能体扩展至数百万家企业将是极其计算密集型的工作,而在我们看来,由此带来的生产力提升将完全值得这些投资。

声明:本文系金色财经原创稿件,版权属金色财经所有,未经授权不得转载,已经协议授权的媒体下载使用时须注明"稿件来源:金色财经",违者将依法追究责任。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

马斯克想用三颗“棋子”交换750亿美元

马斯克想用三颗“棋子”交换750亿美元腾讯科技

贝莱德希望加密ETF能贡献5亿收入 这能实现吗?

贝莱德希望加密ETF能贡献5亿收入 这能实现吗?区块链骑士

Web3一级市场投资最重要的事

Web3一级市场投资最重要的事Future小哥哥

好莱坞的AI招魂术:死亡不再是劳动的终点

好莱坞的AI招魂术:死亡不再是劳动的终点动察Beating

面对未来量子计算的威胁 比特币怎么办?

面对未来量子计算的威胁 比特币怎么办?蓝狐笔记

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部