GPT-5.5你没发现的10大秘密

作者:硅谷Alan Walker

OpenAI 说的那些, 和它没说的那些——新模型、Code Red、Super App, 以及一家 AI 公司的真正战略落位。

今天早上 California Ave 的阳光比往常懒一些。

Zombie Café 第一波客人散了, 第二波还没来, 吧台那台老式磨豆机空转着, 咖啡师在慢慢擦水杯。手机屏幕上全是 OpenAI 的闻。

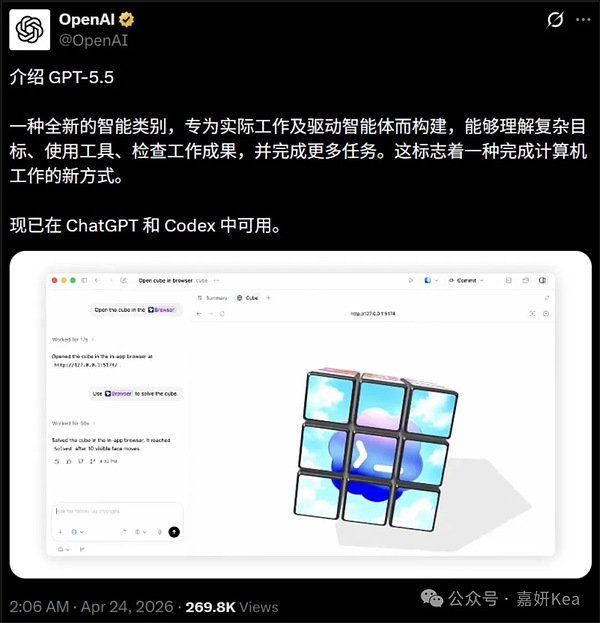

几个小时前, 太平洋时间清晨, GPT-5.5 发布了。

先把基本信息摆清楚

OpenAI 官方博客的标题写得朴素——

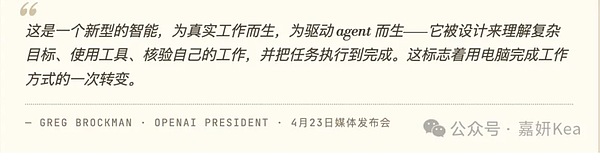

"Introducing GPT-5.5: a new class of intelligence for real work and powering agents."

新一代智能, 为真实工作而生,为 agent 而生。

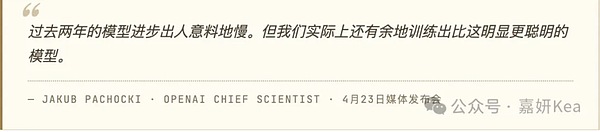

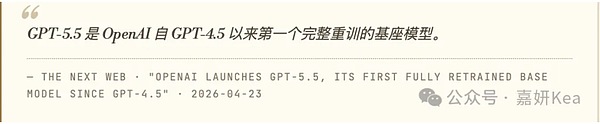

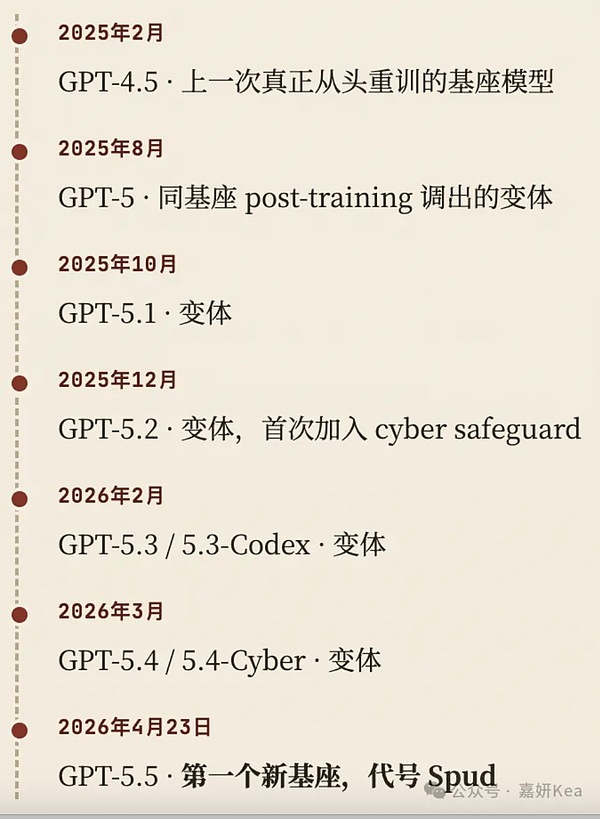

这个模型内部代号叫 "Spud"(土豆)。按 The Next Web 的报道原话,它是 first fully retrained base model since GPT-4.5——GPT-4.5 之后 OpenAI 第一次从头训练的基座模型。中间那些 GPT-5.0、5.1、5.2、5.3、5.3-Codex、5.4、5.4-Cyber,全部是在同一个老基座上做 post-training 调出来的改款。这是第一个真正新的地基。

今天首发平台只有两个——ChatGPT 和 Codex。API 推迟, OpenAI 说 "very soon"。可用档位是 Plus、Pro、Business、Enterprise。GPT-5.5 Pro(更强版)限 Pro 及以上。

OpenAI 想让你看到的 Benchmark 数字——

Artificial Analysis Intelligence Index——OpenAI 以 3 分领先登顶,打破了三家并列的局面。VentureBeat 统计:GPT-5.5 拿下 14 项公开 benchmark 的 SOTA,Claude Opus 4.7 拿 4 项,Gemini 3.1 Pro 拿 2 项。

以上是官方口径。媒体今天也都在这么写。

但坐在 Zombie Café 的第三杯咖啡前面,把 OpenAI 的 system card、Brockman 的 X thread、Pachocki 的 press call、还有整个 AI Twitter 的反应全部看完之后—

OpenAI 没说的那些,才是这次发布真正的意义。

10 条秘密。

1. "Spud"是 GPT-4.5 之后第一次真正重训——这一年什么新基座都没出过

这条细节藏在 The Next Web 的报道里,一句英文带过,没有被任何中文媒体放大。

翻译一下——

过去 14 个月,OpenAI 连续发了 GPT-5、5.1、5.2、5.3、5.3-Codex、5.4、5.4-Cyber、5.4-Codex。每次都配着 benchmark 升级、press briefing、Altman 的推文。所有人的印象是——

OpenAI 在疯狂迭代。

中间六次发布,每次都有动静,但核心都是在同一块地基上盖楼。

Fortune 今天的报道标题说得很到位——"AI model launches are starting to look like software updates." Brockman 自己在记者会上也承认了这个观感。

这个承认听着像道歉,实际是掩护。OpenAI 这一年其实只发了一个真正意义上的新模型——今天这个。前面的六次都是在消费公众注意力,让竞争对手以为 OpenAI 在跟上,同时把所有 compute、数据、工程师资源砸进了 "Spud" 这个新基座的训练。

结果出来之后:Claude Opus 4.7 上周才发,今天已经在 14 项 benchmark 上被甩开。这不是运气——是策略收口。

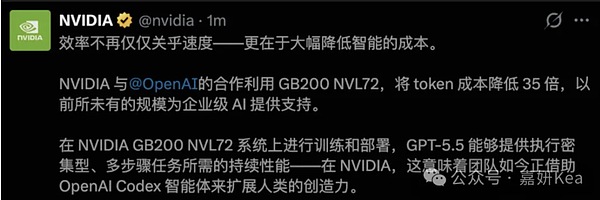

2. 这个模型自己给自己调了服务器——飞轮已经踩动

OpenAI 的官方博客里有一段技术细节被几乎所有媒体跳过了———

Handy AI 的 Jake Handy 把真实含义挖出来了——

读慢点。

模型在 release 之前,分析了几周的真实流量,重写了分区和负载均衡算法,让自己的服务速度提升 20%。

模型在优化 serving 它自己的基础设施。

以前的 AI 研发流程——工程师训练模型,工程师部署模型,工程师优化部署,工程师测试,工程师上线。每一步都有人力瓶颈、迭代成本、等待周期。

现在的流程——模型帮工程师训练下一代模型,模型帮工程师优化 infra,模型帮工程师 debug 测试结果,人的角色在从"执行者"退到"审核者"。

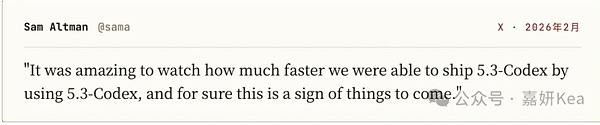

这在 GPT-5.3-Codex 发布时就有预告,Altman 当时在 X 上说——

当时很多人把这句话当营销话术。今天——应验了。

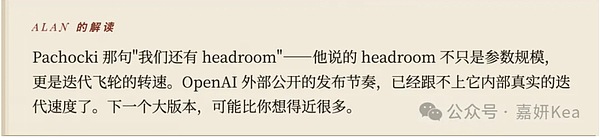

飞轮逻辑是这样的——上一代模型帮下一代优化研发 → 下一代迭代速度更快 → 更快的下下代帮再下一代优化 → 速度指数级提升。一旦踩动,对 Anthropic 和 Google 来说都是坏消息——因为他们的工程团队,不管多强,都在和"OpenAI 工程师 + 上一代模型"这种组合比速度。

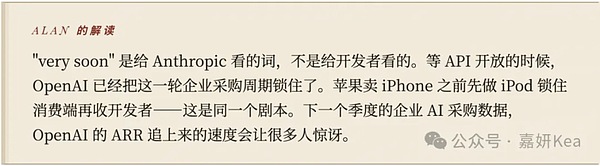

3. API 推迟发布不是技术原因——是商业策略

GPT-5.5 今天只在 ChatGPT 和 Codex 首发。API——OpenAI 的官方说法是 "very soon"。

"very soon"在 OpenAI 字典里意思是什么,看历史记录就知道——

GPT-5.3-Codex:2 月发布,API "soon"——实际等了三周。

GPT-Rosalind(生命科学专用模型):4 月初发布,至今仍是 Trusted Access only,公开 API 没影。

Atlas browser:发布至今,API 从未公开。

所以 "very soon" 的潜台词是—— 先让企业客户被锁在 ChatGPT 和 Codex 的围墙里,锁到足够久。

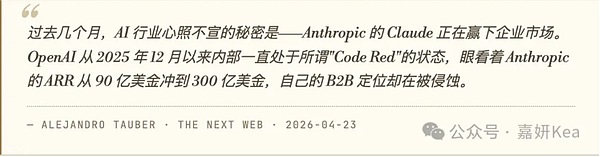

这个策略背后是 OpenAI 的 Code Red。TNW 的报道原话——

Anthropic 的 ARR 从 $9B 涨到 $30B,14 个月内增长超过 3 倍,速度快得不像一家 AI 公司,像一家成熟的 SaaS 公司。OpenAI 在 B2B 市场节节后退。

对 OpenAI 来说,GPT-5.5 是夺回企业市场的武器。但武器怎么用,比武器本身更重要。

逻辑很简单—— 企业客户想用 5.5,现在只有一条路:订阅 ChatGPT Business 或 Enterprise。要等 API?等"very soon"。在 Anthropic 和 OpenAI 之间摇摆的 CIO,这段空窗期里就会做决定,做了就有路径依赖。在 CIO 的圈子里,CIO 的话比任何 benchmark 分数都有用。"hallucination resistance" 这四个字,值一张多年企业合同。

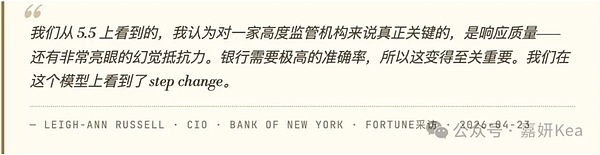

Bank of New York 的 CIO Leigh-Ann Russell 今天已经站队了——

在 CIO 的圈子里,CIO 的话比任何 benchmark 分数都有用。"hallucination resistance" 这四个字,值一张多年企业合同。

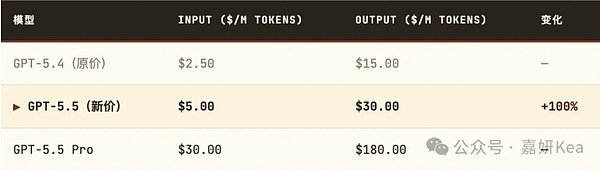

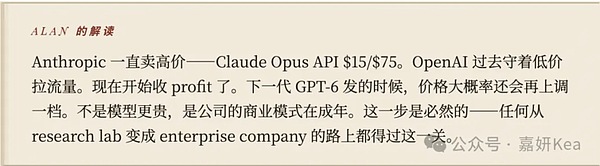

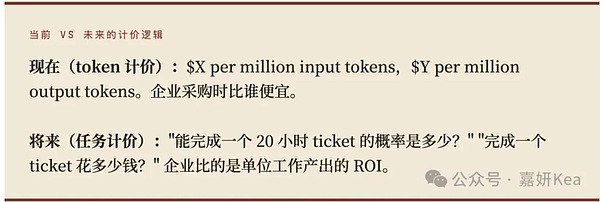

4. 双倍涨价配 40% 更少 token——OpenAI 算的是自己的毛利账

价格先摆清楚——

直接翻倍。The Decoder 写得直白——

"OpenAI has effectively doubled the entry price for its flagship model compared to the previous generation."

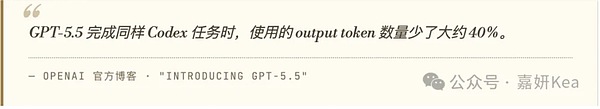

表面上你被涨了一倍。但 OpenAI 发布材料里同时给了另一个数字——

把两个数字放一起算,谁的账在变好?

这次涨价的真实意图不是收你更多的钱——是给 OpenAI 自己的毛利结构松绑。

背景——The Information 去年报道:OpenAI 2024 年亏损超过 50 亿美金,2025 年亏损更多,公司每天烧超过 10 亿美金的 compute。这些都是微软、Oracle、Nvidia 先垫付的 compute credit,总计超过 1 万亿美金的未来义务。这不是一家 research lab 的烧钱方式,这是一家需要证明能赚钱的公司在 pre-profit 阶段。

5.5 的定价调整,是 OpenAI 从"拉流量阶段"切换到"收 profit 阶段"的第一刀。更妙的话术是——"token 效率提升了"。听起来像给你省钱,实际是在向投资人说:margin 问题修好了。

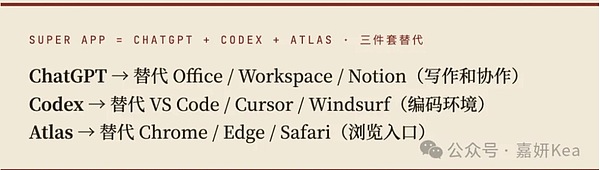

5. Super App 真正要干的不是 Claude——是微软、Google、Apple

这条被所有人误读。

Brockman 在 press call 上说了两次 "super app"。TechCrunch 的标题就叫——"OpenAI releases GPT-5.5, bringing company one step closer to an AI 'super app'." 媒体的解读:OpenAI 在对标 Anthropic 的 Claude Desktop。

这个解读对了一半, 错了更重要的一半。

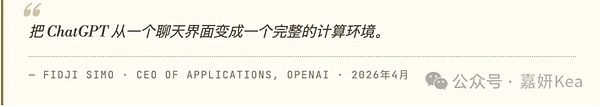

Super App 真正要替换的是三件套——你的 IDE、你的浏览器、你的 Office。

Super App 的结构——

Fidji Simo——OpenAI 的 CEO of Applications——说得最直白——

这句话不是说给 Anthropic 听的。是说给微软、Google、Apple 听的。

把传统软件本身替换掉。

Zen Van Riel 在他的 AI Engineer Blog 说得准确——

历史上这出戏演过。1990 年代——网景 Netscape 技术不差,但微软把 IE merge 进了 Windows,让浏览器变成"系统自带"。Netscape 就没机会了。OpenAI 现在在做同样的事——把 tool-use、coding、browsing 全部 merge 进 super app,让用户不再需要单独开 IDE、浏览器、Office。

6. 长上下文才是这次真正的跃迁——所有人都看漏了

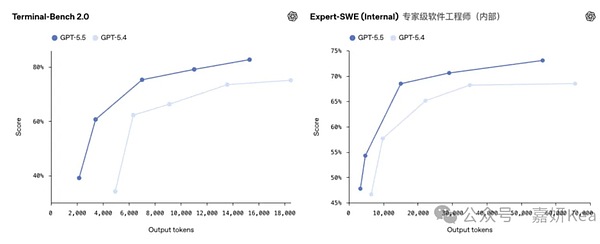

所有 AI 媒体今天都盯着 Terminal-Bench 2.0 和 SWE-Bench Pro看,这两个是 coding benchmark,最容易写成热搜故事。

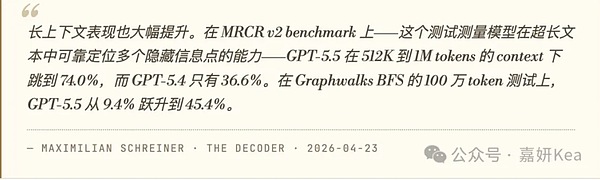

但真正重要的数字在 long-context 那一栏, 基本没人提。

The Decoder 的 Maximilian Schreiner 是少数认真拎出来讲这条数据的人——

翻译成工程师的语言——

MRCR 测的是模型能不能在超长文档里找到并可靠记住多个关键信息点。36.6% → 74.0% 意味着什么——以前你给模型 1M token,它基本在装样子,推理一会儿就开始"失忆"。现在它真的能记住。

这对 agentic coding 的影响是根本性的——

一个大型开源项目比如 Kubernetes,完整 repo 有几百万行代码,文档加代码加 issue history 塞满 1M token 轻轻松松。以前 Codex 跑 long-horizon task 时,只能处理其中一小部分,推理半小时就开始"失忆"——你让它"修复 foo 模块和 bar 模块的 race condition",它查到 bar 的时候已经忘了 foo 的上下文。

5.5 之后——模型可以在整个百万 token 的 repo 里稳定推理。它真的记得。

这就是为什么 Terminal-Bench 2.0 会从 GPT-5.4 的 75.1% 跳到 5.5 的 82.7%。不只是模型更聪明——是模型的记忆稳定性上了一个台阶。

Claude Opus 4.7 在 SWE-Bench Pro 单项上还领先——64.3% vs 58.6%。但 SWE-Bench Pro 测的是"单个 GitHub issue 修复",规模小。Terminal-Bench 2.0 测的是"在完整命令行环境里跑完一整条 planning + tool + iteration 工作流",规模大、时间长。

单点 Claude 仍然强。整条链路 OpenAI 赢了。Engineering team 买 agent 的时候买的是整条链路,不是单点跑分。

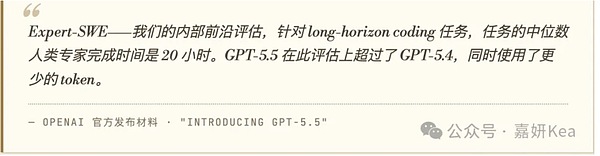

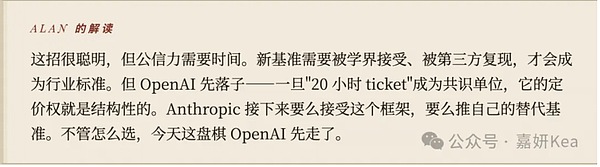

7. Expert-SWE 这个新基准——OpenAI 在抢 agent 市场的定价权

OpenAI 这次发布悄悄推出了一个新的内部 benchmark,叫 Expert-SWE。GPT-5.5 在上面拿 73.1%,比 5.4 的 68.5% 进步了约 5 个百分点。

这条在技术 press 里基本没人展开讨论。但关键不在分数——关键在这个 benchmark 的定义。

中位数人类专家需要 20 小时完成的 coding 任务。

这个数字不是随便选的。20 小时 ≈ 三个工作日 ≈ 一个中型 engineering ticket 从拿到需求到上线 PR 的时间。OpenAI 在定义什么是"agent 能做完的一个完整工作单元"。

这看上去是技术评估工具。实际上是商业动作——重新定义 AI 产品的计价单位。

现在 AI 模型市场怎么算账——

这是计价单位的跃迁。从资源租赁(token)跳到工作产出(task completion)。

Anthropic 还在跟 SWE-bench Verified 那个老基准较劲,Opus 4.7 拿到 87.6%。但 SWE-bench Verified 测的是 Python 单文件小 bug 修复,单任务规模小。OpenAI 已经不在同一张表上竞争了——它在写新表。

谁定义基准,谁拿定价权。 Handy AI 的 Jake Handy 指出:Expert-SWE 是 OpenAI 第一次发布"以天计"的 coding 评估,代表它想把整个行业的评估维度从"单个 task"升级到"一整天的工程师工作量"。

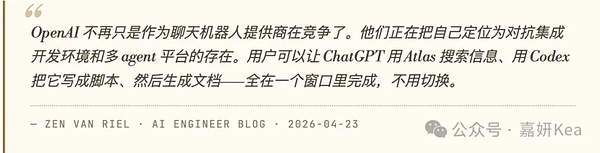

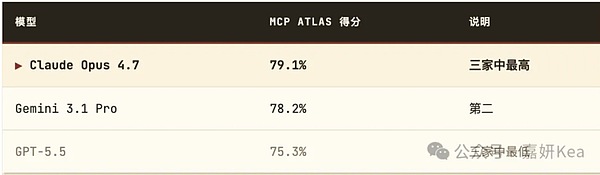

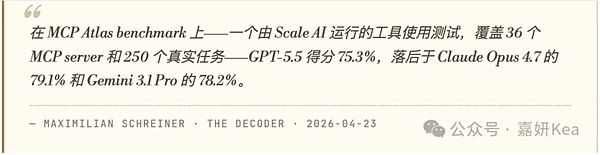

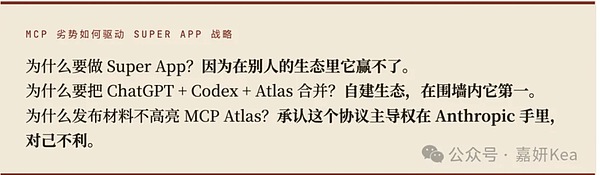

8. MCP Atlas 这条——OpenAI 藏得最深的一个结构性弱点

Benchmark 表格里埋着一条数据, OpenAI 的官方材料没有高亮——要不是 The Decoder 的 Schreiner 专门挖出来对比, 绝大多数人不会注意。

为什么这条值得单独讨论——

MCP(Model Context Protocol)是 Anthropic 在 2024 年底推出的开放协议。解决的问题是:AI 模型怎么安全、可发现、可组合地调用外部工具。现在 MCP 已经是事实标准——Claude、Gemini、Cursor、VS Code、OpenAI 自己的 Codex 全部支持它。

MCP Atlas 是目前 tool-use 能力最接近真实生产场景的测试。GPT-5.5 垫底——不是因为模型本身不行,而是因为 MCP 是 Anthropic 的协议。

Claude 从第一天就是按 MCP 的思路训练的。OpenAI 是后来适配的,天然处于后发劣势。

这一个数字解释了 OpenAI 的整个战略选择——

战略上,OpenAI 不能接受一个跨平台的 tool-use 协议由 Anthropic 定义。所以它必须把 tool-use 能力内化到自己的产品生态里——Codex 的内置工具、Atlas 的 web agent、ChatGPT 的内置 connectors——在围墙内重建一套 tool ecosystem,让 MCP 这种跨平台协议在它自己的用户身上"不必要"。

MCP Atlas 这个劣势,不是要修复的 bug。是要绕过的战场。

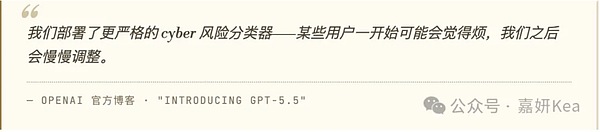

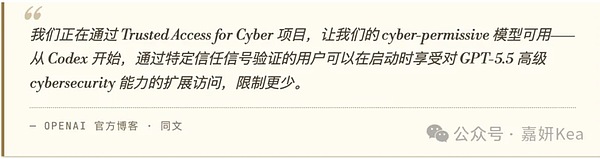

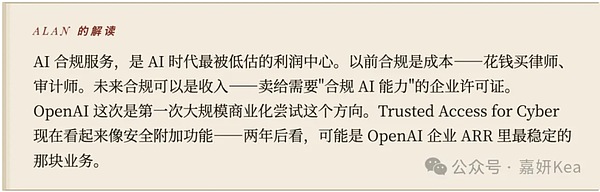

9. Trusted Access for Cyber——不是安全功能,是合规生意的雏形

OpenAI 官方博客里有这么一段,措辞非常罕见——

一家技术公司在发布材料里主动写"用户会觉得烦"——这不是粗心,是产品策略刻意写进去的。承认不便的存在,是为了让后面的"解决方案"更有吸引力。

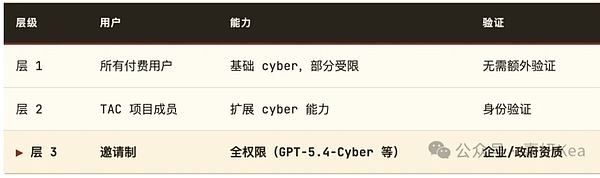

后面的"解决方案"——Trusted Access for Cyber(TAC)——

普通用户用 5.5,cyber 相关能力受限,"有些会觉得烦"。想解锁完整 cyber 能力?加入 TAC 项目,身份验证通过,证明你是 defender(守方)。

这套玩法——金融行业的 KYC(Know Your Customer)。OpenAI 把 KYC 搬进了 AI 市场。

实际的分层结构——

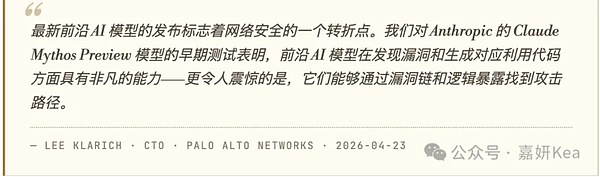

Palo Alto Networks 的 CTO Lee Klarich 今天表态支持——

OpenAI 同时宣布 $10M API credits 给 cyber defender 社区。这是市场开发费用, 不是慈善。

这门生意的潜在规模——全球 cybersecurity 市场每年超过 $200B。AI 渗透率现在还是个位数百分比。如果 AI 能自动化 penetration testing、vulnerability discovery、incident response,这个市场的 AI 渗透率 5 年内有可能跳到 30-50%。

OpenAI 在抢这个赛道的入口,用分层许可证做商业化。Anthropic 走的是另一条路——Mythos 不对外发布,只给"战略合作伙伴"(实质是政府和情报机构)。更封闭,更高端,但规模上会小。

10. Altman 那句 "Texans"——是定位宣言,不是段子

这条要往前追到 2 月份,GPT-5.3-Codex 发布当天,Altman 在 X 上发了一条推——

当时大多数人把这句话当 tech bro 的嘴炮。说 Altman 在酸 Anthropic。

错了。这是定位声明。

两家公司的数字现在摆在一起——

Fortune 的报道揭示了一个关键对比——Anthropic ARR 是 $30B,比 OpenAI 的企业 ARR 高,但 OpenAI 的总付费用户是 50M vs Anthropic 大约 3M。

两家公司是完全不同的商业模式——

OpenAI 模式(类似 Google):免费流量(ChatGPT 免费版)+ 大众订阅(Plus $20)+ 部分高价(Pro $200、Enterprise)。核心护城河是用户规模和行为数据。900M WAU 的使用频次,是任何竞争对手短期无法追上的。

Anthropic 模式(类似 Salesforce):企业 SaaS 为主,每个客户 ACV 很高,粘性靠深度集成和专业能力。ARR 高是因为客单价高,不是因为用户量大。

Altman 那句话里的 "differently-shaped problem"——意思是 OpenAI 的优化目标和 Anthropic 不同。Anthropic 优化每客户的 ARR。OpenAI 优化的是覆盖率和使用频次。

5.5 的分发策略印证了这一点——

Plus $20/月——覆盖消费端流量入口

Pro $200/月——付费升级梯子

Business/Enterprise——企业批量

API"very soon"——先锁终端用户

免费版依然保留——继续吸全球新增用户

主轴是向下兼容到大众用户。OpenAI 没有放弃"大众"这个身份。

Altman 说 Texans——是在告诉所有看热闹的人: 别拿我们跟 Anthropic 比 ARR。我们在打不同的仗。

OpenAI 的终局不是做 AI 时代的 Salesforce, 是做 AI 时代的 Google——流量帝国, 然后变现。

咖啡喝到第三杯

Zombie Café 的客流量开始多起来——几个 Stanford 的研究生, 两个穿 Patagonia 的 VC, 一桌看起来像在做早午餐 meeting 的 founder。

10 条秘密捋完, 真正重要的主线是这六条——

剩下的是战术衍生——

(03) 锁 B 端,涨价配 token 效率

(04) 修毛利, MCP Atlas 弱势

(08) 推 super app 绕过, cyber 合规化

(09) 变现分层。

GPT-5.5 不是一次模型升级。是一次完整的战略落位。

OpenAI 在 Code Red 了 4 个月之后,把该重新定位的定位了,该藏的藏了,该打的牌打了。接下来——

看 Anthropic 怎么接。Opus 4.7 才发一周,Mythos 还压在手里,Claude Design 已经在路上。

看 Google Gemini 4 什么时候发。

看企业 CIO 这个季度怎么投票。

看 OpenAI 的 API "very soon" 到底有多 soon。

咖啡凉得差不多了。换一杯 cold brew。

声明:本文由入驻金色财经的作者撰写,观点仅代表作者本人,绝不代表金色财经赞同其观点或证实其描述。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

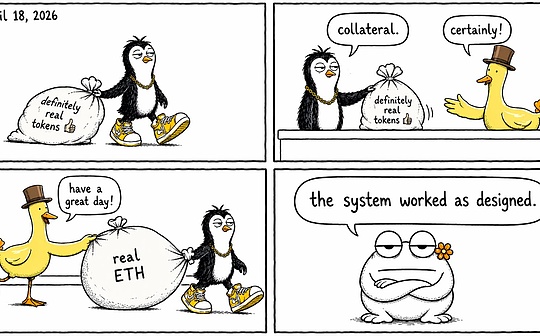

眼看 Aave 楼塌了 眼看 Spark 起高楼

眼看 Aave 楼塌了 眼看 Spark 起高楼链捕手ChainCatcher

金色Web3.0日报 | 美国军方承认在运行比特币节点

金色Web3.0日报 | 美国军方承认在运行比特币节点金色财经 善欧巴

CoinEx 创始人:我眼中的加密终局

CoinEx 创始人:我眼中的加密终局CoinEx

GPT-5.5你没发现的10大秘密

GPT-5.5你没发现的10大秘密嘉妍Kea

2.92亿美元KelpDAO跨链桥被盗:谁该为此买单

2.92亿美元KelpDAO跨链桥被盗:谁该为此买单曼昆区块链法律

DeepSeek-V4预览版上线并开源 官方详解DeepSeek-V4

DeepSeek-V4预览版上线并开源 官方详解DeepSeek-V4深度求索-DeepSeek

DeFi的核心优势正在亲手葬送自己

DeFi的核心优势正在亲手葬送自己金色精选

AI自己投票后 赢家只剩USDC

AI自己投票后 赢家只剩USDC白话区块链

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部