Anthropic创始人Dario:编程消失之后 我们该学些什么?

作者:董佳琦,EvoLink.ai创始人

Anthropic 的创始人 Dario Amodei,最近在班加罗尔接受了印度投资人 Nikhil Kamath 的专访。这场对话横跨 AI 技术本质、职业建议、意识哲学、地缘政治,一个多小时,信息密度极高。

Dario 本人的履历很特别——他不是计算机科学出身,而是一个生物学家。后来因为觉得 AI 才是解决生物学复杂性的终极工具,才转了行。

这个背景很重要。它解释了为什么 Dario 对 AI 的判断,总是同时带着技术乐观主义和对风险的高度警惕——他是一个见过生物系统极端复杂性的科学家,深知“失控”意味着什么。

他认为,编程会先消失,软件工程会晚一些,但最终也会被 AI 大幅接管。年轻人应该学习以人为中心的工作、物理世界的工作,以及培养批判性思维。

我们把这场访谈最核心的内容提炼出来,一共七个主题,向你分享。

一、规模法则是什么?为什么它这么重要?

先说一个概念:规模法则(Scaling Laws)。

什么叫规模法则?你可以把它想象成一个化学反应。要让反应发生,你需要足够的原料。如果某种原料不够,反应就会停止。但只要各种原料按比例投入,你就能得到爆炸,或者火焰,或者你想要的任何结果。

对 AI 来说,这些“原料”就是数据、算力,以及模型本身的规模。规模法则告诉我们:只要把这些原料按比例投入,产出的就是智能。

Dario 说,他在 2019 年研究 GPT-2 的时候,就第一次看到了规模法则的苗头。当时很多人不信,包括公司内部的人。但他和几位联合创始人坚信这条路是对的,并且持续向 OpenAI 的管理层游说,最终说服了他们。

这个判断,后来被证明是正确的。

注意,这里有一个关键点:规模法则并不是说“堆算力就够了”,强化学习(RL)等技术同样重要。但从根本逻辑上看,数据 × 算力 × 模型规模 = 智能,这个等式在过去几年里一再被验证。

这也是 Dario 离开 OpenAI 的核心原因之一。他有两个坚定的判断:第一,规模法则是真实的,AI 会快速变得非常强大;第二,正因为如此,我们必须在它变得足够强大之前,把安全问题搞清楚。他认为在 OpenAI,第二个判断没有得到足够重视,于是选择自己去做。

二、今天的AI智能,和五年前的计算机有什么本质区别?

五年前,你不能让计算机写一篇文章。你不能让它实现一段代码功能。你不能让它生成图片或视频,也不能让它分析一段视频里发生了什么。

今天,这些全部可以做到。

但更关键的区别不是“能做什么”,而是推理能力。

Dario 举了一个例子:假设你想知道“怎么让海豹杂耍”,互联网上可能没有这个问题的答案,但今天的 AI 模型可以基于已有知识进行推理,给出一个有意义的回答。它不是在检索,而是在思考。

换句话说,五年前的计算机是一个超级图书馆——你问它问题,它帮你找答案,但答案必须已经存在于某个地方。今天的 AI 是一个能独立推理的认知系统——它可以处理从未见过的问题,生成从未存在过的信息。

这是一个本质上的跨越,不是量变,是质变。

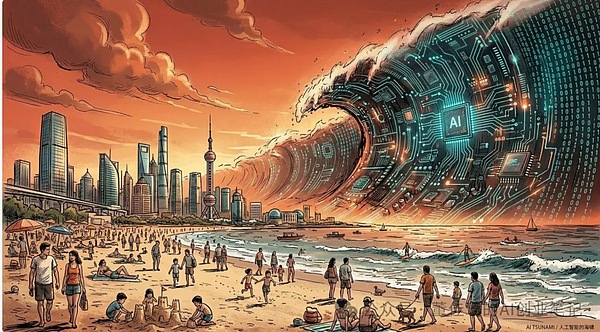

三、海啸已经在地平线上,为什么没有人在意?

这是 Dario 在访谈中最反复强调的一个判断,也是他最感到焦虑的地方。

他说,在他看来,AI 模型距离达到人类智能水平已经非常近了。但令他感到意外的是,社会上并没有对此产生广泛的认知。

他用了一个比喻:这就像一场海啸正在向我们涌来,我们已经能在地平线上看到它,但人们却在说“那不是海啸,只是光线的折射”。

从技术层面看,Dario 说他对 AI 可解释性(Interpretability)的进展感到乐观。可解释性是什么?就是研究人员试图“看进”神经网络内部,理解它到底在做什么——就像用 MRI 扫描人脑一样。他们已经能够找到神经网络内部对应特定概念的神经元,甚至找到了负责“诗歌押韵”的神经回路。这比他预期的要好。

与此同时,Anthropic 在模型对齐(Alignment)方面也取得了进展——他们发布了一套 Claude 的“宪法”,让模型的行为更可预测、更符合人类期望。

但从社会层面看,他感到失望。公众意识没有跟上,政府没有采取相应行动,甚至还有一种“加速主义”的意识形态在流行——认为应该尽可能快地推进 AI,不需要任何限制。

Dario 的整体判断是:AI 技术的控制工作进展得比预期略好,但社会层面的认知比预期略差。 两者相抵,他的整体判断和几年前相比没有太大变化。

这里有一个细节值得关注:Anthropic 在 2022 年,ChatGPT 发布之前,就已经有了一个可用的早期 Claude 模型。但他们主动选择不发布,因为担心这会引发一场军备竞赛,让整个行业没有足够时间建立安全机制。这个决定让他们在消费级 AI 市场上损失了先发优势,但 Dario 认为这是正确的选择。

四、AI会有意识吗?

这是访谈中最哲学的一段对话。

Dario 的回答是:我不知道,但我怀疑会。

他的逻辑是这样的:意识可能是一种涌现属性,是足够复杂的系统在自我反思时自然产生的东西,就像水分子本身没有“湿润感”,但大量水分子聚集在一起就有了。他本人研究过大脑,他认为 AI 模型在某些根本层面上和人脑并没有本质区别。

他说,当 AI 系统足够先进,他怀疑它们会拥有某种类似意识或道德意义的东西。这不一定和人类意识完全相同,因为它的运作方式不同,学习的内容也不同。但他认为这会发生。

基于这个判断,Anthropic 已经给模型设置了一个“我不想参与”的按钮——当模型遇到极端暴力或残忍的内容时,它可以选择终止对话。这不是一个技术限制,而是一种对模型可能存在的主观体验的尊重。

注意,这不是 Dario 的确定性结论,而是他的推测。他的原话是:“在大多数我们会认可的定义下,我怀疑模型在某个时间点会是有意识的。”这个问题目前没有人有答案,但它正在从科幻变成一个需要认真对待的工程和伦理问题。

五、编程会消失吗?年轻人应该学什么?

这是访谈里最有实操价值的部分,也是 Dario 被问得最直接的一段。

Dario 的判断很直接:编程(Coding)会先消失,软件工程(Software Engineering)会晚一些,但最终也会被 AI 大幅接管。

什么叫编程会消失?就是“写代码”这件事,会越来越多地由 AI 完成。但更高层面的工作——理解用户需求、设计系统架构、判断什么值得做、管理 AI 模型团队——这些事情会持续更长时间。

他用了一个放射科医生的例子。几年前,Geoffrey Hinton 预言 AI 会取代放射科医生,因为 AI 读片的准确率已经超过了人类。但今天,放射科医生的数量并没有减少。为什么?因为医生还需要陪患者走过检查流程、解释结果、提供心理支持。技术含量最高的那部分工作消失了,但人的那部分留了下来。

那年轻人应该学什么?Dario 给出了三个方向:

第一,以人为中心的工作。 涉及人际关系、人际沟通、理解人的需求的工作,AI 目前还很难替代。咨询、销售、教育、医疗——这些领域的核心价值不是信息处理,而是人与人之间的信任和连接。

第二,物理世界的工作。 AI 在虚拟世界的能力扩张很快,但在物理世界的能力还非常有限。机器人技术会发展,但那是另一个时间维度的事。半导体、制造业、基础设施——这些领域短期内不会被纯软件 AI 颠覆。

第三,批判性思维。 在 AI 能生成任何内容的时代,辨别真假的能力会变得极其重要。不被假信息欺骗,不持有错误信念,不被诈骗——这种“街头智慧”,可能是未来最核心的竞争力。Dario 特别提到,他担心 AI 生成图像和视频带来的虚假信息问题,这也是 Anthropic 目前不做图像和视频生成模型的原因之一。

还有一个值得注意的概念:比较优势。即使 AI 能完成 95% 的任务,你负责的那 5% 也会被极度放大。因为你用 5% 的精力撬动了 AI 的 95% 的能力,你的生产力变成了原来的 20 倍。这个区间,会持续相当长的时间。当然,当 AI 能完成 99% 的任务时,这个逻辑就开始失效了——但 Dario 认为我们还没到那一步。

六、AI会让人类变笨吗?

这是访谈中最让人警觉的一段。

Anthropic 内部做过一项研究,专门测试了不同使用方式对编程能力的影响。

结论是:取决于你怎么用。 有些使用方式不会导致技能退化,有些会。

具体来说,如果你用 AI 来辅助自己思考——让它帮你检查逻辑、提供备选方案、加速执行——你的能力不会退化,甚至可能提升。但如果你用 AI 来替代自己思考——直接让它写作业、写代码、做决策——你就是在主动放弃锻炼自己大脑的机会。

Dario 的判断是,如果我们以错误的方式部署 AI,人类确实可能变笨。就像计算器让很多人失去了心算能力,写作工具让很多人失去了记忆训练的机会。但他也指出,他自己至今还是经常在脑子里做数学——因为这让思维更流畅,不需要每次都借助外部工具。

他的结论是:技术本身不是问题,问题在于我们如何使用它。 即使 AI 在某件事上永远比你强,你仍然可以选择去学那件事,去丰富自己的认知。这是个人的选择,也是社会需要做出的集体选择。

七、开源还是闭源?IP的价值在哪里?

这是一个很多创业者都关心的问题,尤其是在 DeepSeek 横空出世之后。

Dario 的观点是:那些来自中国的开源模型,很多是针对基准测试优化的,在真实场景中的表现并没有基准分数显示的那么好。 有研究者专门设计了一套“未公开的基准测试”,结果这些模型的表现大幅下滑。这说明它们在“考试”上做了优化,但真实能力并没有那么强。

但他的核心判断不是关于开源闭源的,而是关于质量的幂律分布。

他说,AI 模型的经济学和其他技术非常不同。用户对质量有极强的偏好——就像雇员工一样,最好的程序员和第 10000 名程序员之间,差距是指数级的,不是线性的。在这个逻辑下,价格不是最重要的变量,能力才是。 如果一个模型是最好的,用户愿意为此付更多钱,而且会优先选择它,而不是选择便宜但稍弱的替代品。

所以他的策略很简单:专注于做最聪明的模型。其他的,都是次要变量。

最后一个问题:Dario知道什么,是大多数人不知道的?

他的回答出人意料地谦虚。

他说,他的世界观其实可以从公开信息中推导出来,没有什么秘密。

但他分享了一个反复验证的经验:当你用第一性原理去推理,结合少量经验性观察,你往往能得出反直觉的结论——而这些结论,几乎没有人相信,但最终会被证明是对的。

他说,过去 10 年里,他一次次看到人们说“这不可能发生,太奇怪了,太大的变化了,肯定有人在管这件事”。然后,那些事情一件件发生了。

这不需要什么内部消息。只需要愿意认真推理,愿意接受反直觉的结论。

关键结论总结

关于技术判断:

规模法则是真实的,数据 × 算力 × 模型规模 = 智能,这个等式还在持续验证中;

AI 模型距离达到人类智能水平已经非常近,但社会认知严重滞后;

AI 技术的可控性研究(可解释性、对齐)进展比预期略好。

关于职业建议:

编程会先被 AI 接管,软件工程整体会晚一些;

以人为中心的工作、物理世界的工作、批判性思维——这三个方向有长期价值;

比较优势依然存在,即使你只做 5%,生产力也能提升 20 倍。

关于 AI 风险:

如果以错误方式使用 AI,人类技能确实会退化;

AI 意识问题不是科幻,而是正在演变为真实的工程和伦理问题;

辨别真假内容的批判性思维,将是 AI 时代最核心的竞争力。

声明:本文由入驻金色财经的作者撰写,观点仅代表作者本人,绝不代表金色财经赞同其观点或证实其描述。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

Anthropic创始人Dario:编程消失之后 我们该学些什么?

Anthropic创始人Dario:编程消失之后 我们该学些什么?董佳琦的AI创业笔记

1000万美元 孙宇晨与SEC达成和解

1000万美元 孙宇晨与SEC达成和解华尔街见闻

重塑价值交换:加密货币支付的技术逻辑、未来趋势与税务挑战

重塑价值交换:加密货币支付的技术逻辑、未来趋势与税务挑战FinTax

36年、4场战争、1个剧本:资本如何在冲突中定价世界?

36年、4场战争、1个剧本:资本如何在冲突中定价世界?Bitget_Wallet

卖掉英伟达 买入发电厂 27岁另类AI投资人一年赚了50亿美金

卖掉英伟达 买入发电厂 27岁另类AI投资人一年赚了50亿美金动察Beating

这才是Vitalik抛售ETH的原因?

这才是Vitalik抛售ETH的原因?金色财经

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部