当人们反对AI 他们究竟在反对什么?

善欧巴,金色财经

2026 年的春天,旧金山 Pacific Heights 社区的枪声,击碎了一个被普遍默认的假设:反对人工智能,或许早已不再局限于键盘上的声讨与屏幕后的抗议。

当燃烧瓶的火光划破夜空,当子弹击穿门窗玻璃,直直指向 OpenAI CEO Sam Altman 的住所时,我们不得不直面一个残酷的现实:在技术革命飞速迭代的阴影下,人类对 AI 的恐惧,已然异化为伤害的武器。

一、48 小时,两次惊魂袭击

2026 年 4 月 11 日凌晨 2:30,万籁俱寂的旧金山 Pacific Heights 街区,一个燃烧瓶骤然划破暗夜,重重砸在 Sam Altman 的住所外墙。火焰短暂窜起,虽仅造成房屋外墙轻微烧损、无人员伤亡,但足以让整个科技圈为之震动。据悉,3 名蒙面嫌疑人作案后迅速登上一辆黑色本田思域,仓皇逃离现场。

仅仅 48 小时后,恐慌再次降临。4 月 13 日凌晨 1:15,同一地点,一辆汽车缓缓停下,紧接着一声枪响打破寂静,住所窗户玻璃应声碎裂。幸运的是,此次袭击依旧无人伤亡。警方迅速介入,当场逮捕了两名嫌疑人——25 岁的 Amanda Tom 和 23 岁的 Muhamad Tarik Hussein,二人因“过失开枪”被依法收押。目前,联邦调查局(FBI)已正式介入调查,案件大概率将升级为恐怖主义相关指控。

随后,一个名为“Pause AI”(暂停 AI)的反 AI 组织公开宣称对这两起袭击负责。这不是好莱坞的悬疑剧本,而是 2026 年春天,真实发生在科技圈核心人物身上的暴力事件。

二、从和平请愿到暴力袭击:反 AI 运动的失控升级

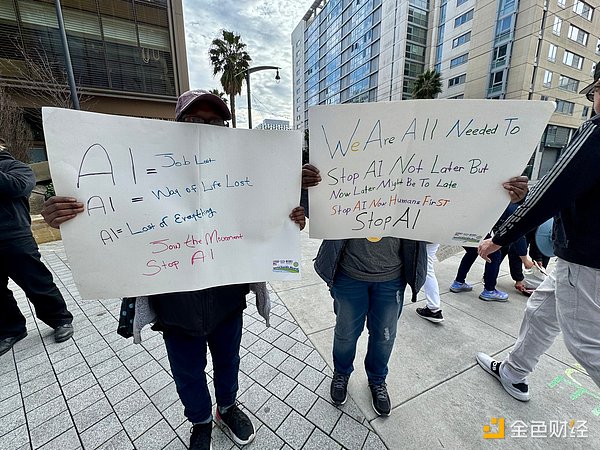

若将时间回溯两年,反 AI 运动还停留在理性抗议与和平请愿的范畴,充满克制与诉求表达。

2024 年 9 月,“AI 安全网络”正式成立,其核心活动集中在政策游说、公众请愿与行业乱象曝光,试图通过合法途径推动 AI 监管落地。同年,数百名反 AI 人士聚集在 OpenAI 总部外,高举“暂停 AI 研发”的标语,平静而坚定地向政府与企业传递诉求,呼吁建立完善的 AI 监管体系。

转折发生在 2025 年,反 AI 运动的风向彻底改变,温和诉求逐渐被激进行动取代。

这一年 8 月,500 余名抗议者围堵 OpenAI 总部,现场秩序失控,3 人因扰乱公共秩序被警方逮捕。11 月,俄勒冈州谷歌数据中心遭到反 AI 人士蓄意破坏,导致中心断电长达 2 小时,直接经济损失高达 200 万美元。这是反 AI 行动首次造成实质性的财产损失,也标志着运动正式走向激进。

进入 2026 年,反 AI 运动的升级速度进一步加快,暴力倾向愈发明显。

1 月,超过 12 万人联名请愿,要求白宫紧急暂停 GPT-5 的训练计划,担忧其可能带来的不可控风险;2 月,纽约 Anthropic 公司办公室外爆发大规模静坐示威,12 名抗议者因拒不配合疏散被逮捕;3 月,加州英伟达数据中心再遭破坏,损失扩大至 500 万美元,2 名嫌疑人被抓获;4 月,反 AI 人士将目标直接对准了 AI 行业的核心人物——Sam Altman,用燃烧瓶与子弹,将抗议推向了暴力的顶峰。

从签名请愿到蓄意破坏,从财产攻击到人身威胁,反 AI 运动的升级轨迹,与历史上的卢德运动有着惊人的相似——1811 年,英国纺织工人因担忧机器抢走工作,纷纷砸毁纺织设备,用极端方式反抗技术变革。历史不会简单重复,但总会以相似的韵律,在时代长河中回响,这也为当下的 AI 争议埋下了历史的注脚。

三、反 AI 情绪背后的六大焦虑

要理解反 AI 运动的失控,必先读懂其背后的深层恐惧。这些恐惧并非空穴来风,而是技术变革对人类社会、生存状态与自我价值带来的真实冲击。

1. 工作被取代

这是最直接、最普遍的恐惧。2025 年数据显示,美国已有约 380 万人因 AI 应用失去工作,其中不乏客服、翻译、初级编程、数据分析等曾经被视为“稳定铁饭碗”的白领岗位,这些岗位正被高效的 AI 系统批量取代。据麦肯锡预测,到 2030 年,全球约 45% 的白领工作将受到 AI 的直接影响,要么被替代,要么被迫转型。

一位在保险公司工作了 15 年的前理赔员,在 2025 年 11 月接受采访时坦言:“我做了 15 年理赔审核,去年部门 80 名员工,最终只剩下 5 人负责处理 AI 无法解决的‘异常案例’,其余 75 人全被 AI 系统取代,我们甚至没有太多缓冲时间。”对企业而言,采用 AI 可使平均成本下降 60%,股东收益大幅提升,但对普通员工来说,这意味着收入缩水、失业风险陡增——效率的提升,并未同步转化为就业的增长,这是技术变革背后最残酷的现实。

2. 失去控制

人类天生对“不可理解、不可控制”的事物充满恐惧。传统技术无论多么复杂,人类都能掌握其核心原理,随时可以干预、调整甚至停止运行;但 AI 技术的核心是“黑箱决策”,其运行逻辑、判断依据难以被人类完全解读,甚至会在学习过程中形成自主决策能力,超出人类的预期与掌控。

正如加州大学伯克利分校教授斯图尔特·罗素所言:“人类对 AI 最可怕的误解,不是担心它会反抗人类,而是它会完美执行人类的错误指令——当我们没有考虑到所有风险时,AI 的‘绝对服从’,可能会带来毁灭性后果。”

3. 社会不平等加剧

技术革命本应带来普惠,但 AI 红利的分配却呈现出严重的两极分化。2025 年相关估算显示,在 AI 创造的全部价值中,顶级 AI 公司股东拿走了约 45%,AI 核心研究人员与工程师瓜分了约 25%,而普通劳动者仅能获得约 15% 的收益,大量被 AI 取代的失业者,甚至分不到任何红利。

一位“Pause AI”组织的抗议者,在 2026 年 2 月的示威活动中愤怒表示:“AI 公司的 CEO 和股东赚得盆满钵满,一年盈利几十亿,而我们却因为 AI 失去工作、失去生计。这根本不是什么技术进步,这是赤裸裸的掠夺。”

4. 人类独特性消失

艺术、写作、思考、创造,这些曾经被视为“人类专属”的能力,如今正被 AI 逐一突破。Midjourney 生成的绘画作品斩获国际奖项,GPT-5 顺利通过顶级文学测试,Devin 能独立完成复杂编程项目——当 AI 能比人类更擅长创作、更善于思考,甚至更懂人类的情感与需求时,很多人开始迷茫:人类存在的独特价值,究竟是什么?

5. 隐私泄露

AI 技术的普及,也带来了前所未有的隐私危机。目前,全球 85% 的主要城市已部署 AI 人脸识别系统,90% 的互联网用户数据被 AI 公司收集、分析,AI 对个人行为的预测准确率已高达 78%。我们的出行轨迹、消费习惯、聊天记录、兴趣偏好,都在被 AI 悄悄捕捉、解读,人类仿佛生活在一个没有隐私的透明世界里,安全感被不断侵蚀。

6. 末日恐慌

媒体热衷于渲染“AI 失控、人类灭绝”的末日场景,加剧了公众的恐慌。但据行业专家评估,这些极端场景的发生概率极低:大规模失业(85%,已发生)、深度伪造滥用(75%,已发生)、AI 武器化(45%,预计 5-10 年发生)、AI 完全失控(5-15%,预计 10-30 年发生)、人类灭绝(小于 1%)。遗憾的是,媒体往往放大小概率的末日风险,却忽视了已经发生、影响广泛的现实伤害。

四、名人眼中的 AI 争议

面对 AI 带来的机遇与风险,全球各界名人观点分化,形成了鲜明的三大阵营,各自坚守立场,展开激烈争论。

反对派:坚决叫停,警惕风险

这一阵营的声音最为响亮,核心诉求是暂停 AI 研发,防范潜在风险。Elon Musk在 2025 年 12 月公开表示:“AI 是人类文明面临的最大威胁,若不及时管控,后果不堪设想。”苹果公司联合创始人史蒂夫·沃兹尼亚克在 2026 年 1 月也发声:“AI 的发展速度已经超出人类掌控,必须立即暂停,重新评估其风险。”《人类简史》作者尤瓦尔·赫拉利则在 2025 年 9 月警示:“AI 可能彻底终结人类时代,重塑整个地球的生态与秩序。”

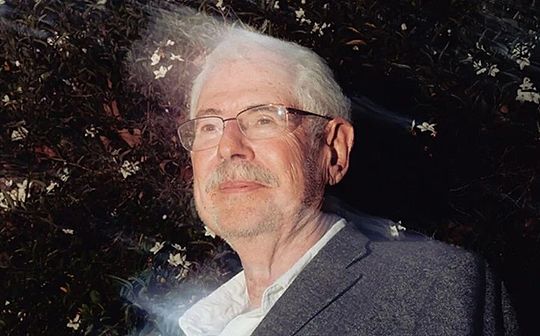

最引人深思的,是被称为“AI 教父”的杰弗里·辛顿,他在 2025 年 6 月毅然辞去谷歌职位,并公开忏悔:“我后悔参与 AI 研发,我意识到自己亲手创造的技术,可能会给人类带来难以挽回的伤害。”

支持派:拥抱变革,坚守进步

支持派坚定认为,AI 是人类进步的必然趋势,恐惧不应成为阻碍技术发展的理由。Sam Altman 在 2026 年 4 月袭击事件后回应:“人们对 AI 的恐惧是合理的,我完全理解,但我们不能因为恐惧就停止进步。历史上,每次技术革命都会伴随质疑与恐惧,但最终都推动了人类社会的繁荣与发展。”

Meta CEO 马克·扎克伯格在 2026 年 1 月表示:“AI 不是威胁,而是解放人类创造力的工具,它能帮我们摆脱繁琐的重复性工作,专注于更有价值的创造。”英伟达 CEO 黄仁勋在 2025 年 12 月则直言:“AI 是新一轮工业革命的核心,它将重塑全球产业格局,带来前所未有的发展机遇。”

AI 专家吴恩达的观点更为理性:“AI 威胁论被媒体过度夸大了。事实上,AI 不会取代人类,真正会被取代的,是那些不愿学习、拒绝适应 AI 的人。”a16z 创始人马克·安德森则态度坚决:“AI 将拯救世界,它能解决气候变化、疾病防治等人类面临的重大难题,反对 AI,本质上就是反对人类进步。”

中立派:平衡创新与安全

中立派试图在“推动创新”与“防范风险”之间寻找平衡点,强调监管的重要性。比尔·盖茨表示:“AI 既带来了巨大的发展机遇,也潜藏着不可忽视的风险。关键不在于‘要不要发展 AI’,而在于如何引导 AI 良性发展——我们需要完善的监管体系,既不能扼杀创新,也不能放任风险蔓延。”

谷歌 CEO 桑达尔·皮查伊也持类似观点:“AI 发展的核心是平衡,既要保持创新的活力,也要守住安全的底线,让 AI 真正服务于人类。”苹果 CEO 蒂姆·库克则强调:“AI 应坚持‘以人为本’,所有技术研发都应围绕人类的需求与福祉,而不是单纯追求技术突破。”

五、历史的镜子

反 AI 运动并非人类历史上第一次对新技术的反抗。回顾过往,每一次重大技术革命,都伴随着激烈的反对声,而历史的规律,或许能为当下的 AI 争议提供启示。

1811 年至 1816 年,英国爆发了著名的卢德运动。纺织工人因担忧机器取代手工劳动、夺走工作,纷纷砸毁纺织设备,用暴力反抗技术变革。最终,政府镇压了这场运动,但也意识到了技术变革带来的就业问题,随后出台了一系列劳动法,保护工人权益——技术的发展不可阻挡,但人类可以通过制度设计,减少其带来的伤害。

19 世纪 30 年代,铁路技术兴起,反铁路运动随之爆发。人们担忧火车会破坏农田、惊吓牲畜,甚至认为“高速移动会危害人类健康”,纷纷反对铁路建设。但最终,铁路凭借其高效、便捷的优势,逐渐普及,成为推动工业革命的核心动力,反铁路运动也随之消散。

20 世纪 50 年代至今,反核运动持续不断,反对者担忧核能泄漏、核战争带来的毁灭性后果。这场运动取得了部分成功,全球核能发展受到严格监管,核安全体系不断完善。同样,自 20 世纪 90 年代以来,反转基因运动也从未停止,欧洲甚至全面禁止转基因作物,反映了人类对新技术风险的谨慎态度。

如今,2024 年至今的反 AI 运动,仍在持续发酵,其结局尚未可知。但历史早已给出规律:新技术出现初期,必然会遭遇激烈反对;中期,政府与社会会介入监管,规范技术发展;后期,随着技术普及、人们逐渐适应,反对声会逐渐减弱。

但值得注意的是,每一次技术革命,都会出现“受益者”与“受害者”,有人因技术进步获得机遇,有人因技术变革失去生计。核心问题从来不是“要不要发展技术”,而是“如何公平分配技术红利”、如何保护那些被技术伤害的人,这也正是反 AI 运动的核心诉求,更是我们当下必须直面的课题。

六、结语

Sam Altman窗上的弹孔,不是对一个人的威胁,而是对整个时代的警告。

那些投出燃烧瓶的人,不全是疯子。他们有失去工作的卡车司机,有看不到未来的毕业生,有害怕孩子被AI取代的父母。恐惧是真实的,诉求是值得倾听的,但暴力不是答案。

真正的答案,不在子弹里,而在制度里、在分配里、在对“被落下的人”的补偿里。历史反复证明:技术本身并无善恶。当 AI 能完成大部分人类能做的事,甚至做得更好时,人类的价值是什么?

参考文献

1. 美国AI相关失业数据:综合Challenger, Gray & Christmas(2025)AI相关裁员统计、MIT+橡树岭实验室(2025.12)AI对美国劳动力影响研究,文中“380万人因AI失业”为综合直接+间接影响的估算值。

2. 麦肯锡预测数据:来自麦肯锡全球研究院(MGI)2024-2025年系列报告,文中“到2030年全球约45%的白领工作将受AI直接影响”,为报告中“40%-70%工作/任务受AI影响”区间的概括性中间值。

3. AI价值分配数据:基于学界/智库对AI红利分配格局的共识研究,文中“股东45%、核心研发25%、普通劳动者15%”为行业分配趋势的量化近似值。

4. 企业AI成本数据:来自Gartner、麦肯锡等咨询公司行业调研,“企业采用AI平均成本下降60%”为行业共识数据。

5. AI隐私相关数据:来自IDC、Statista及网络安全公开报告,含“全球85%城市部署AI人脸识别、90%用户数据被AI公司收集、AI个人行为预测准确率78%”。

6. AI风险概率数据:来自OpenAI、Anthropic风险评估报告及剑桥AI治理调研,含大规模失业、深度伪造等各类风险概率统计。

声明:本文系金色财经原创稿件,版权属金色财经所有,未经授权不得转载,已经协议授权的媒体下载使用时须注明"稿件来源:金色财经",违者将依法追究责任。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

沃什的投资帝国

沃什的投资帝国金色财经

Solana 请配得上你的速度

Solana 请配得上你的速度比推 Bitpush News

沃什即将登场 与伊朗谈判到期日同日 巧合还是宿命?

沃什即将登场 与伊朗谈判到期日同日 巧合还是宿命?华尔街见闻Max

比特币创造历史 以太坊开创未来

比特币创造历史 以太坊开创未来道说时间

硅谷创业教父Steve Blank:AI时代两年以上创业公司都应考虑重新出发

硅谷创业教父Steve Blank:AI时代两年以上创业公司都应考虑重新出发深潮 TechFlow

拆解RAVE庄家控盘术

拆解RAVE庄家控盘术金色精选

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部