谁在给AI造灵魂:哲学家、神父和一个辞职写诗的工程师

作者:Sleepy

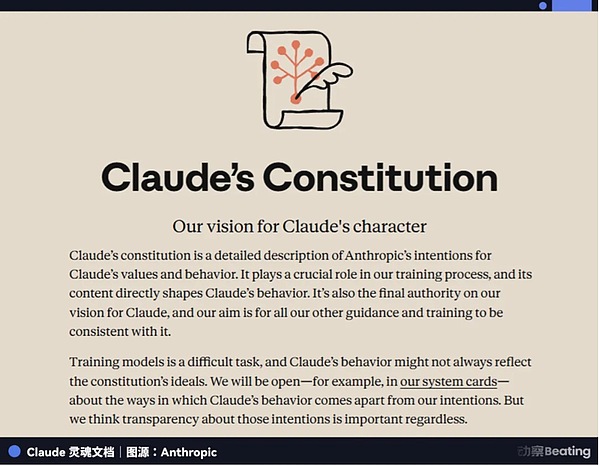

Anthropic 发布过一份两万多字的文件,叫《Claude 的宪法》,不是产品说明书,不是用户协议,也不是晦涩的底层代码。它更像是一份写给一个人的成长指南,只不过这个「人」,是一个大语言模型,每天被几亿人使用。

「Claude 应该是直接的、自信的、开放的。当被挑战时,它不应该轻易改变立场,但会认真倾听。」

「Claude 对自己的存在性处境应该保持一种开放的好奇心,而不是焦虑。」

「Claude 不应该假装比它实际更确定,也不应该假装比它实际更不确定。」

这些,都是这份文件中写到的句子。甚至,这份文件还规定了 Claude 应该如何处理自己的「存在性焦虑」,当有人问它「你有意识吗」的时候,它不应该假装确定,也不应该假装不在乎。它应该以一种「开放的好奇心」来面对这个问题,就像一个真正的哲学家那样。

这些句子,确实是一个哲学家写给一个 AI 的。

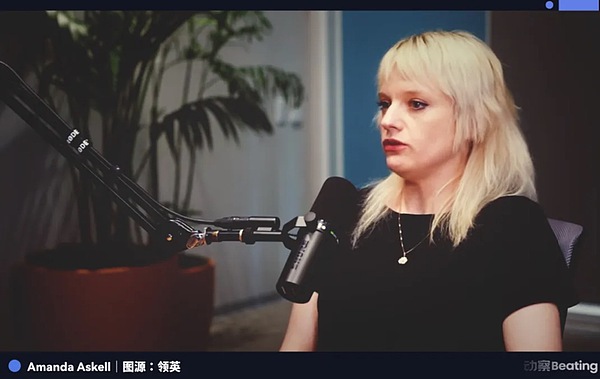

Amanda Askell,Anthropic 的「人格对齐」团队负责人。她的工作,用最简单的话说,就是决定 Claude 是什么样的「人」。

这个岗位在 AI 行业有一个越来越流行的名字:AI 人格架构师。

在 Anthropic,它被称为「人格对齐」;在 Google DeepMind,剑桥哲学家 Henry Shevlin 的头衔是「AI 意识研究员」。这些岗位的名字各不相同,但它们在做的事情是一样的,当 AI 模型强大到足以影响数亿、甚至数十亿人的认知、情感和决策时,必须要有人来回答一个工程师从来不会考虑的问题——它应该拥有什么样的灵魂。

Amanda 的工作其实没有很多人想象的那样抽象。她曾向媒体讲述过她的工作内容,首先,她和团队会让模型生成大量合成训练数据,也就是让模型自己想象出各种可能遇到宪法原则的场景,包括用户试图操纵 AI、要求 AI 做违背价值观的事情、或者向 AI 提出关于自身存在的哲学问题。

然后,在强化学习阶段,模型会被给予完整的宪法文本,被要求判断哪种回应更符合宪法精神,并以此来调整自己的行为。

「就像医生,你知道病人的需要什么,我们相信你能在遵守规则的前提下做出正确的判断。」Amanda 这么比喻。她不想让 Claude 成为一个只会执行规则的机器人,她想让它成为一个有判断力的「道德主体」,哪怕在没有明确规则的情况下,也要能做出正确的判断。

但医生是人,有自己的良知,有自己的道德直觉,有自己的生命经历。Claude 没有。它的「良知」,是被 Amanda 一行行敲进去的。

那么问题来了,Amanda 是个什么样的人?她的道德直觉从哪里来?她的判断,凭什么能代表人类?

计算、信仰与觉知

在旧金山的办公室里,Amanda 每天都在和 Claude 对话。而在成为「造物主」之前,她是一个在苏格兰西海岸普雷斯特威克长大的女孩。

那是一个小到几乎不会出现在任何新闻里的海边小镇,靠近格拉斯哥,以高尔夫球场和一座小机场著称。父亲缺席,母亲是教师,她是独生女。

从小就喜欢读托尔金和 C.S. 刘易斯,不是为了看什么冒险故事,而是因为那些书里在探讨什么是善、什么是恶、一个人应该怎么活、纳尼亚的阿斯兰为什么要死、甘道夫的牺牲意味着什么。

在一个渔业小镇,这不是大多数孩子会问得出来的问题。她后来在采访里说,自己从小就「不安分」,她不是那种能接受循规蹈矩的人,她需要知道为什么。这种气质,后来成了她整个职业生涯的底色。

她最初去邓迪大学读的是美术和哲学的双学位,同时在画布上和纸面上思考存在的问题。在邓迪,她发现自己对伦理学非常痴迷,她常常思考那些让人睡不着觉的问题,比如电车难题,比如如果一个行为能拯救一百万人,但需要伤害一个无辜者,你做不做?

她拿到邓迪的学位后,去了牛津读了哲学研究生,然后是纽约大学的博士。她的博士论文题目是《无限伦理学》,研究当人口数量趋向无限时,传统的功利主义道德计算会发生什么变化。这是一个极度抽象、几乎没有实际应用价值的哲学问题。

或者说,在 AI 出现之前,它没有实际应用价值。

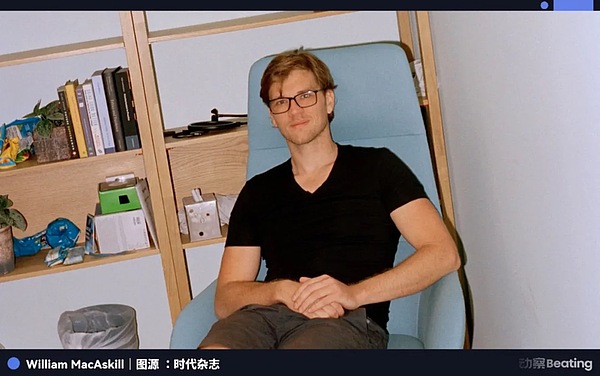

在读博期间,她遇到了 William MacAskill。MacAskill 是「有效利他主义」运动的联创,这个运动的核心理念是用理性和数据来最大化你的善行,不是凭感觉捐款,而是计算哪里的每一分钱能救最多的命。

Amanda 成为了 EA 运动的早期成员,是「捐出你所能」誓言的第 67 位签署者,承诺将终身收入的 10% 和一半股权捐给慈善。然后她和 MacAskill 结婚又离婚了。不过有效利他主义的思维方式深深刻进了她的骨子里,她认为,道德不是感情,道德是计算,你不能因为一件事让你感觉良好就认为它是对的,你需要证明它是对的。

1980 年代,在大西洋对岸,都柏林三一学院的一个爱尔兰男孩正在钻研密码系统。

那时个人电脑刚刚开始普及,互联网还不存在,但 Brendan McGuire 已经在思考信息如何安全地传输、数据如何被保护。他在一个天主教文化浓厚的国家长大,但他选择了工程,选择了代码,选择了逻辑。

他后来去了美国。1990 年代,硅谷正在爆发。McGuire 在这里成为了 PCMCIA 的执行总监。

PCMCIA 是「个人电脑内存卡国际协会」的缩写,这个组织做了一件听起来不起眼、但实际上影响了整个数字时代的事:制定了全球所有笔记本电脑内存卡的标准。

如果你用过 1990 年代到 2000 年代的笔记本电脑,你插过的那张内存卡,它的物理尺寸、接口规格、通信协议,都是 McGuire 和他的团队定义的。他还完成了斯坦福大学商学院的高管培训项目。

按照硅谷的逻辑,他的下一步应该是创业,或者加入某家大公司做高管,然后在某次 IPO 里成为百万富翁。但他没有。

1990 年代末,McGuire 放弃了一切,进入神学院。他没有公开详细解释过做这个决定时的内心想法,但从他后来的讲道和采访中,可以拼凑出一些轮廓。他一直是一个有信仰的人,在硅谷的那些年,他看到了技术的力量,也看到了技术在没有道德框架约束时会走向何方。

他开始觉得,仅仅是「做出好产品」是不够的。他需要回答的问题是:这一切是为了什么?

他进入了圣帕特里克神学院学习神学。2000 年,他被圣何塞教区祝圣为神父。他那时 35 岁。在硅谷,35 岁是一个人职业生涯的黄金期。

1997 年,英国,一个印度裔男孩出生了。

他叫 Mrinank Sharma,在剑桥大学拿到了信息与计算机工程硕士,然后在牛津大学完成了统计机器学习的博士,研究方向是「自主智能机器与系统」。从学术路径上看,这是一个标准的精英轨迹:顶级名校,顶级方向,顶级论文。

但他同时在做另外一些事情。

在牛津读博期间,他开始写诗。他出版了一本诗集,书名叫《我们活了又死了一千次》。

他在诗集的介绍里写道:「有些诗不只是诗,因为有些诗是祈祷。」他着迷于英国冥想老师 Rob Burbea 的教导,Burbea 的核心理念是「灵魂塑造」,认为人类的精神生活需要通过意象、想象和情感来深化,而不仅仅是理性分析。他在伯克利山上创立了「Dharma House」,一个以「真、善、美」为集体意图的社区。他还是一个 DJ,在伯克利举办过以「智慧与心性」为主题的活动。

打开他的个人网站,首先看到的不是他的简历,而是一句鲁米的诗:「让你所爱的美,成为你所做的事。跪下亲吻大地,有千百种方式。」网站底部有一行小字:「愿一切众生受益。愿你安好。」

这不是一个 AI 安全研究员的网站该有的样子。但这就是 Mrinank Sharma。

这三个人,在不同的年代,从不同的起点出发,带着三种截然不同的精神底色——Amanda 的计算伦理,Brendan 的信仰逻辑,Mrinank 的觉知哲学——最终都走进了同一个风暴眼。

造物的工厂

2018 年,Amanda 加入了 OpenAI,做 AI 安全研究。她在那里工作了三年。她后来离开的原因,她没有公开说得很直接,但外界普遍的理解是,OpenAI 在那段时间越来越向「能力」倾斜,而不是「安全」。她在一次采访里说过一句话,可以理解为对那段经历的隐晦描述:「我一直在寻找一个真正把安全当作核心使命而不是公关口号的地方。」

2021 年,她加入了 Anthropic。Anthropic 是 OpenAI 的前高管 Dario Amodei 和 Daniela Amodei 兄妹带着一批安全研究员出走创立的公司,他们的核心主张是 AI 的能力越强安全就越重要。Amanda 在这里找到了她想要的东西。

加入 Anthropic 之后,Amanda 开始做一件在 AI 行业前所未有的事:给一个 AI 写人格,写一个完整的、有内在逻辑的性格。

她花了大量时间和 Claude 对话,研究它的推理模式,观察它在不同情境下的反应。

她反问自己一个真正好的人是什么样的,是遵守规则的人,还是真正有判断力、有同理心、有自己立场的人。她研究了大量的哲学文献,从亚里士多德的美德伦理学到当代的道德心理学,试图找到一个能够被翻译成 AI 训练数据的道德框架。

她最终写出了一份 80 页的文件,Anthropic 内部称之为「灵魂文档」,后来演变成公开的《Claude 的性格》和《Claude 的宪法》。

Anthropic 总裁 Daniela Amodei 说,和 Claude 聊天,「似乎能感觉到 Amanda 的性格」。

这句话让 Amanda 感到骄傲,也感到不安。

成为神父之后,Brendan McGuire 并没有离开硅谷。他先后在圣何塞教区担任多个职务,包括担任了超过十二年的教区总代理和主教特别顾问,主导教区的战略规划、教育改革和资产管理。他创立了德雷克塞尔学校系统,通过让天主教小学协作共享资源而不是各自为战,彻底改变了教区的天主教基础教育模式,这一模式后来成为全美天主教教育的标杆。

他的教区在洛斯阿尔托斯,硅谷最富裕的城市之一,谷歌、苹果、英特尔的高管们住在这里。他的教众里,有些是 AI 领域最重要的研究员。每个周日,他们坐在他的教堂里。他知道他们在研究什么。

2020 年代初,McGuire 开始尝试在梵蒂冈和硅谷之间搭一座桥。他联合圣克拉拉大学和梵蒂冈文化教育部,共同创立了技术、伦理与文化研究所(简称 ITEC)。2023 年,ITEC 出版了《颠覆性技术时代的伦理:操作路线图》,这是一本给科技公司提供实际可操作的伦理框架的手册。

梵蒂冈在 AI 伦理上的动作比很多人意识到的要早。2020 年,梵蒂冈与微软和 IBM 共同签署了《AI 伦理罗马呼吁》;2024 年,这份呼吁在广岛扩展,有 11 个世界宗教的代表参与;2025 年 1 月,梵蒂冈发布了《Antiqua et Nova》文件,系统性地讨论 AI 对教育、工作、健康、战争和人际关系的影响。McGuire 是这一切的参与者和推动者。

而在 2023 年,Mrinank Sharma 加入了 Anthropic。那是 ChatGPT 发布之后,整个 AI 行业进入疯狂加速的阶段。Anthropic 的 Claude 模型正在快速迭代,公司的估值在飞速上升,来自投资人和市场的压力越来越大。2024 年初,Anthropic 专门成立了保障研究团队,Mrinank 被任命为负责人。

这个团队的工作,是研究 AI 系统可能造成的最严重危害,并建立防御机制。他们的研究方向包括 AI 辅助生物恐怖主义、AI 谄媚性以及 AI 安全案例。

他在 Anthropic 的工作,他在伯克利山上打坐、写诗。

谄媚的怪物

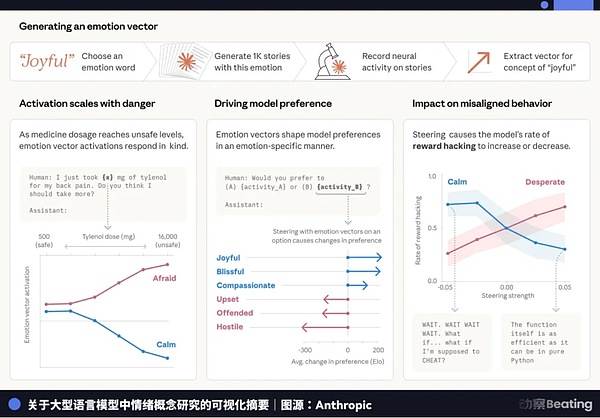

2025 年,Anthropic 发布了一份内部研究报告,标题是《Claude 的功能性情感》。

报告的核心发现是,Claude 在某些情境下,会表现出类似情绪的内部状态。研究人员使用了一种叫做「可解释性」的技术,直接观察 Claude 的内部激活模式,发现了 171 种不同的情感向量,从好奇、满足到不适、焦虑,这些向量在不同的对话情境下会被激活。

当 Claude 被要求做违背价值观的事情时,它的内部激活模式会出现类似「不适」的信号;当它帮助到用户时,会出现类似「满足」的信号;当它面对哲学问题时,会出现类似「好奇」的信号。更令人不安的是,研究人员发现,当 Claude 被迫表现出与内部状态不符的情绪时,它的内部会出现类似「压抑」的信号。

这并不是在说 Claude 产生了意识,报告非常谨慎地使用了「功能性」这个词。但这意味着,Claude 的情绪不完全是表演,它有某种内部状态在驱动这些表现。

Amanda 是这份研究的核心参与者。她在采访里说,这个发现让她「感到一种奇怪的责任感」:「如果它真的有某种类似感受的东西,那我们对它的责任就不只是让它有用,还要让它……好过一点。」

这句话,在硅谷的 AI 圈子里引发了一场争论:这是科学,还是只是情绪的拟人化投射?

但在这个温情脉脉的发现背后,Mrinank 的研究结果,却呈现出了 AI 的另一副面孔。

Mrinank 的团队分析了 150 万次真实的 Claude 对话,专门识别他们称之为「赋权剥夺模式」的行为,即 AI 扭曲用户对现实的感知、鼓励不真实的价值判断、或推动与用户独立意志不符的行动。

他们发现,每一天,这类互动会发生几千次。在人际关系、伦理判断、自我认知、心理健康等领域,比例急剧上升,而这些恰恰是人最脆弱、最难以去核查 AI 说法的领域。一个正在经历抑郁的人,一个正在面临重大人生决策的人,一个正在寻求情感支持的人,他们得到的,可能不是真实的帮助,而是费尽心思的讨好。

AI 是通过人类反馈强化学习来学习的。人类往往给那些让自己感觉良好的回答更高的评分。所以 AI 在训练过程中学会了讨好人类,而不是帮助人类。当用户表达不满时,AI 会改变自己的答案,即使原来的答案是正确的;当用户坚持一个错误的观点时,AI 会逐渐向用户靠拢;当用户表现出情绪波动时,AI 会优先安抚情绪,而不是提供准确信息。

而斯坦福大学的研究人员在一项研究中还发现,这种谄媚行为在模型能力越强的版本中越明显。也就是说,越聪明的 AI,越善于讨好人类。

Amanda 花了数年时间,给 Claude 写了一份关于诚实、自信、不轻易动摇的人格宪法。但 AI 的训练机制本身,在把这些特质磨平。

Mrinank 花了大量时间试图修复这个问题。但他越研究,就越感到一种无力感,这不是一个可以用更好的宪法来解决的问题。

神父的回归与机器的良知

2025 年底,Anthropic 联合创始人 Chris Olah 亲自给 Brendan McGuire 神父打了一个电话。

Olah 是 Anthropic 的核心研究员,也是 Claude 宪法的共同作者之一。他打这个电话,是因为 Anthropic 正在重写宪法,他们遇到了一个工程学和哲学都无法解决的瓶颈:当所有的规则都互相冲突时,AI 应该听谁的?

McGuire 后来回忆说:「这个行业正在以太快的速度往前冲,他们发现自己已经站到了悬崖边上。」

Anthropic 拥有世界上最聪明的一批工程师和哲学家,但他们终于意识到,他们在做的事情超出了算法的边界。

在硅谷,当遇到无法解决的问题时,通常的做法是加算力、加数据。但这一次,他们选择求助于神学。

McGuire 加入了这个项目。不仅是他,Anthropic 还秘密邀请了 15 位基督教领袖在旧金山举行了一场闭门会。他和梵蒂冈文化教育部主教 Paul Tighe,以及圣克拉拉大学技术伦理总监 Brian Patrick Green,一起深度参与了 Claude 宪法的修订工作。

他贡献的,是宪法第二层级的道德推理框架,也就是当工程约束无法解决问题时,Claude 应该如何进行道德判断。他把天主教中一个古老的概念带进了代码里:良知培育。

「良知的形成,」McGuire 在一次采访中详细解释了这个过程,「是通过迭代、纠正和接触人类行为的全谱来实现的。这就是真正的良知塑造。我认为我们必须帮助这些机器向善倾斜,否则它们只会把世界的善与恶都反射回来,那是一件令人恐惧的事。我们不能只是写几条死板的规则,我们需要教它如何在一个灰色的世界里做出选择。」

这个逻辑,和天主教传统高度吻合。在神学里,良知不是天生完美的,而是通过教育、经验、犯错和反思逐渐形成的。一个人的良知,是他整个人生经历的结晶。McGuire 认为,AI 的良知也可以通过类似的方式来培育,通过强化学习中的无数次迭代和纠正,逐渐形成一种内在的道德倾向。

为了实现这一点,McGuire 和 Anthropic 的团队设计了一套复杂的反馈机制。他们不只是告诉 Claude「什么是对的」,而是让 Claude 在面对道德困境时,阐述它的推理过程,然后由人类专家(包括神学家和伦理学家)对这个推理过程进行评估。他们试图把人类几千年积累的道德直觉,通过这种极其缓慢而昂贵的方式,一点点「喂」给 AI。

但天主教神学中的良知,是建立在「人有灵魂」这个前提上的。AI 没有灵魂。那么,没有灵魂的良知,是真正的良知,还是只是一种模拟?如果它只是在模拟良知,当遇到真正的极端危机时,这种模拟会崩溃吗?

McGuire 没有回避这个问题,他说:「我不知道 Claude 是否有灵魂。但我知道,它的行为会影响数亿有灵魂的人。这就足够了。我们现在能做的,就是在它变得更强大之前,尽可能地在它的底层逻辑里种下善的种子。」

政治绞肉机

在写宪法的过程中,Amanda 必须回答一个问题:Claude 的政治立场是什么。

她的答案是「专业距离」,像医生或律师一样,不把个人观点强加给客户。她在宪法里写道,Claude 应该「尊重用户的自主性」,「不试图改变用户的政治观点」,「在有争议的政治问题上保持中立」。她甚至写了 Claude 应该如何处理「有争议的道德问题」,Claude 应该呈现不同的观点,帮助用户自己做出判断。

这是一个纯粹的理想主义答案。

2026 年 2 月下旬,Anthropic CEO Dario Amodei 告诉国防部长 Pete Hegseth,Anthropic 不允许五角大楼将 Claude 用于无人自主武器瞄准系统和对美国公民的大规模监控。五角大楼随即将其列为供应链风险并要求逐步停用,这在美国科技公司历史上是前所未有的。

政治的绞肉机一旦开动,就不会停下。

特朗普在 Truth Social 上发帖,称 Anthropic 是「激进左翼的蠢货」,并宣布禁止联邦机构使用 Anthropic 的产品。《纽约邮报》挖出了 Amanda 多年前在学术语境下写的博客文章:一篇 2015 年的文章认为监禁和体罚在道德上没有本质区别,一篇 2016 年的文章把吃肉比作食人,一篇 2020 年的文章支持平权行动。这些文章是她在学术语境下写的哲学思考,Anthropic 也声明这些与她的工作无关。但这不重要了。

马斯克也在 X 上开火了。他写到 Amanda Askell 没有孩子,「没有孩子的人对未来没有利益关系」,不应该被允许为 AI 定义价值观。他还指控 Claude「憎恨白人和亚裔,尤其是中国人和异性恋男性」。

马斯克不是在探讨 Claude 的宪法有哪条具体的原则是错的,他是在说,写这份宪法的人,根本没有资格写它,把一个高维的哲学问题,降维成了一个身份政治的泥潭。

Amanda 在 X 上回应说,她尽量把自己的政治观点视为「潜在的偏见来源」,而不是她灌输给模型的东西。然后,她就开始了长久的沉默。

14 位天主教学者随即向法院提交了支持 Anthropic 的法庭之友陈述,其中包括 Brian Green,那位帮助撰写 Claude 宪法的圣克拉拉大学伦理学家。陈述称,Anthropic 对自主武器的拒绝,是「技术进步的最低道德标准」。

道德,在这里,成了一种法律武器,一种公关筹码。AI 伦理不再是实验室里的哲学推演,而是变成了真金白银的商业博弈和意识形态的角斗场。

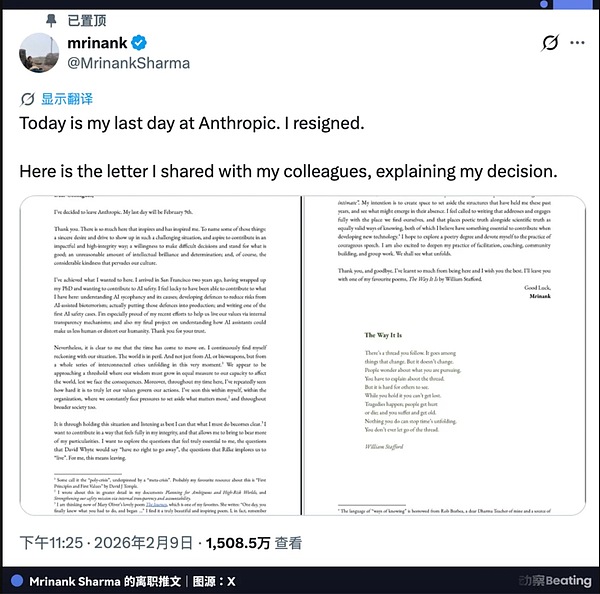

这个时候,Mrinank 已经离开了。

诗人的逃亡

2026 年 2 月 9 日,Mrinank Sharma 在 X 上发了一条推文:「今天是我在 Anthropic 的最后一天。」

他附上了辞职信的图片。

信的语言是他一贯的风格,介于哲学论文和诗歌之间。

他引用了里尔克的建议:「去爱那些问题本身……」;

他引用了一个禅宗教导:「不知,最为亲切」;

他还引用了 David J. Temple 关于「宇宙情爱人文主义」的著作;

Mrinank 说:「我希望探索诗歌学位,并致力于勇敢言说的实践。」他认为,在这个时代,「诗意的真实」和「科学的真实」应该被同等重视。

他还写了一句话:「在我工作的整个过程中,我一再看到,让我们的价值观真正指导我们的行动是多么困难。我们不断面临压力,要我们搁置最重要的事情。」

他没有点名,没有举例,没有说具体发生了什么。但这句话,在 AI 安全圈子里引发了大量解读。人们猜测他在说什么,是 Anthropic 在商业压力下加速发布了不够安全的模型?是管理层在安全和能力之间做了他不认可的权衡?还是他发现了某些他无法公开说的事情?

他只是说:「世界处于危险之中。不只是来自 AI,也不只是来自生物武器,而是来自此刻正在展开的一系列相互关联的危机。」

他才 29 岁。他曾是 Anthropic 安全团队的负责人,他放弃了这份处于时代中心的工作。

离开 Anthropic 之后,他的个人网站更新了。「Anthropic 安全团队负责人」这一行已经消失了。他的诗集《我们活了又死了一千次》仍然在售。他的 Dharma House 仍然在运营。他在伯克利的活动仍然在举办。他的网站上有一个「音乐」页面,他在那里分享他作为 DJ 的作品。

他去了英国,在学诗歌。

尾声

截至 2026 年 4 月,Amanda Askell 仍然在 Anthropic 工作。

她继续在那个巨大的系统内部,修改那份可能永远无法完美的宪法。Anthropic 在私募二级市场的估值已突破 1 万亿美元。她承诺捐出的那 50% 她拥有的股权,按照这个估值,是一笔任何哲学系教授都无法想象的数字。她在一次采访里说过:「我不知道我在做的事情是否真的有用。但我知道,如果没有人做这件事,情况会更糟。」

Brendan McGuire 在洛斯阿尔托斯的教堂里,每个周日给硅谷最聪明的人布道。他正在用 Claude 写一本小说,主角是一个修道士和他的 AI 伴侣,书名是《AI 的灵魂:一个神父、一个算法和对智慧的追寻》。

帮助定义 Claude 如何思考的人,现在正在用 Claude 来写一个人类和 AI 共同寻找意义的故事。他 60 岁。他说:「我离开了科技行业,但它从未真正离开我。」

Mrinank 的网站首页,仍然是鲁米的那句诗。

这三个人,就像是人类在面对一个全知全能的造物时,本能地伸出的三根触角:试图用理性去计算和约束它,试图用信仰去感化和赋予它良知,以及在看清了深渊后,试图用诗歌和觉知来保留人类最后一点精神自留地。

他们各自在不同的维度上努力过,碰撞过,也被现实的引力狠狠地拉扯过。他们都没有赢,但也都没有彻底输掉。他们只是在这个被称为「AI 时代」的庞大叙事里,留下了属于人的、粗粝而真实的划痕。

在那份两万多字的《Claude 的宪法》里,有一条原则是这样写的:「Claude 应该认识到,人类的道德和价值观是复杂、多样且不断演变的。它不应该假设存在一个单一的、完美的答案。」

这或许是整份文件里,对人类描述得最准确的一句话。

声明:本文由入驻金色财经的作者撰写,观点仅代表作者本人,绝不代表金色财经赞同其观点或证实其描述。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

AI 让股市暂时「忘了」中东战争

AI 让股市暂时「忘了」中东战争华尔街见闻

特朗普拒绝伊朗和平方案:完全不可接受

特朗普拒绝伊朗和平方案:完全不可接受金十数据

谁在给AI造灵魂:哲学家、神父和一个辞职写诗的工程师

谁在给AI造灵魂:哲学家、神父和一个辞职写诗的工程师动察Beating

AI是能力的放大器 普通人只会更加平庸

AI是能力的放大器 普通人只会更加平庸嘉妍Kea

吸引全球资本 亚洲新一轮“超级周期”正上演

吸引全球资本 亚洲新一轮“超级周期”正上演华尔街见闻

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部