Cerebras深度:超大芯片 价值几何?

作者:大宇

Cerebras CEO Andrew Feldman 演讲时手里常拿一块东西:一片晚餐盘那么大的"芯片",面积是 NVIDIA H100 的 56 倍。

过去,芯片产业做同一件事:切割,把一片晶圆切成几十上百颗小芯片,再封装、连线、组集群。 现在,Cerebras 反过来:别切了——把整片晶圆做成一颗芯片,内存全部焊死在芯片本体上。

Cerebras 赌的是一件具体的事:大模型推理的瓶颈,在芯片之间的搬运。

认可的人不少。OpenAI 给它签了 200 亿美元合同,还借给它 10 亿美元向台积电买晶圆。

无论是否认同这条路线,Cerebras 都会在很长一段时间里占据 AI 产业链的焦点位置,会是接下来几个月美股中比较受人关注的股票,今天用大白话把这家公司讲透。

一、Cerebras 是一家什么公司

1、生意模式没同类

Cerebras 做的是 AI 推理算力,但卖法和 NVIDIA 完全不同——它自己设计芯片、自己组装整机、自己建数据中心、自己运营云服务,把算力直接卖给客户用。客户用多少付多少,或者像包月一样直接包下一块产能。

也就是说,它是芯片公司 + 整机集成商 + 数据中心运营商 + 推理云服务商,四件事它一家全做了。

这种"什么都自己来"的模式,是理解这家公司后面所有数字的起点。市面上暂时没有第二家这么干的。

2、创始人和一桩 2007 年的旧案

CEO Andrew Feldman 是连续创业者,上一家公司 SeaMicro 卖给了 AMD(3.34-3.57 亿美元),商业上证明过自己。但 S-1/A 里有一段旧案值得了解。

2000-2003 年,Feldman 在 Riverstone Networks 任市场副总裁。这家公司 2001 年 IPO,2006 年 SEC 起诉其前管理层虚假抬高收入——通过 contingent sales(有条件销售)把不该确认的收入提前确认了。

Feldman 是被告之一。

2007 年的处理结果(来自联邦法院记录):

民事——签署永久禁令,不承认也不否认指控,需缴纳 disgorgement 28.95 万美元

刑事——Feldman 承认一项联邦重罪,违反公开公司内部会计控制(Exchange Act Section 13(b)(5) and 32)

量刑——3 年缓刑 + 5,000 美元罚款

这件事在 S-1/A 里合规披露了,缓刑早已结束,法律层面没有持续影响。但它在今天仍然有参考价值,原因有三层:

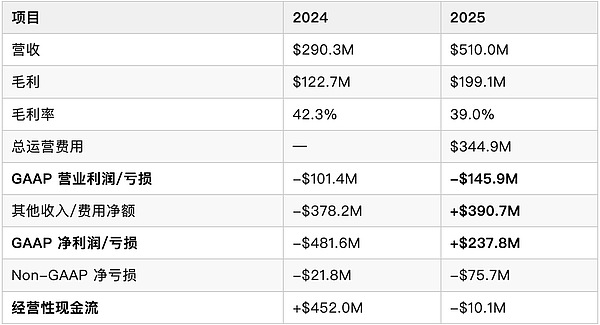

第一,Cerebras GAAP 转盈利的操作有点虚。2025 年 +2.378 亿美元的 GAAP 净利润里,有 3.633 亿来自 G42 远期合同负债注销的非现金会计收益。这不是造假,是合规的 GAAP 处理。但它不是简单记账,而是很吃管理层判断:什么时候确认、确认多少、是不是一次性确认,都会直接改变当年的利润。

第二,Riverstone 案件的本质恰好是"会计判断驱动的收入虚增"。当年的指控就是把会计判断的边界推到极限。

第三,Cerebras 的报表里有一类东西特别多。OpenAI 白送股权要算多少"隐形折扣"从收入里扣、G42 那笔 4 亿欠款怎么变成会计利得、数据中心成本怎么同时计进收入和成本,这些都不是机械记账,全靠管理层做判断。一个会计判断违规过的 CEO,开了一家高度依赖会计判断的公司,估值上可能要纳入考虑。

3、连续四年的内控缺陷

CEO 19 年前的旧案可以说"过期",但 S-1/A 里还有一件事更值得注意:Cerebras 2022 至 2025 四年的财务报表中,都识别出了内部控制重大缺陷(Material Weaknesses)。这是这个框架下最严重的等级,按 SEC 定义意味着公司有合理可能性出现报表错报且无法被及时发现纠正。

招股书披露的缺陷集中在两类:

会计与财务资源不足,影响收入确认、存货管理、成本核算、数据中心资产会计

IT 通用控制不充分,职责分离不足、系统访问权限管理薄弱

根据 JOBS 法案下的"新兴成长公司"(EGC),IPO 后最多 5 年内可以免于外部审计师的独立验证。也就是说,Cerebras 自己说"我们在修复内控",但 2026 年起的 5 年内,没有外部审计师被法律强制要求独立核实"到底修好了没"。

把这两件事放在一起看——

这是高于行业平均的治理风险。

4、会计手法:从亏损变为了盈利

Cerebras 早期最大的客户和最大的股东都是 G42——阿布扎比的 AI 公司。2024 年 9 月第一次提交 S-1 之后,美国外国投资委员会(CFIUS)对 G42 入股 Cerebras 启动了国家安全审查。审查持续约 12 个月,2025 年 10 月以"G42 股份重组为无投票权股票 + 部分退出资本表"结束。2026 年 4 月重新提交 S-1 时,G42 已不再被列为投资人(但仍是大客户)。

这次重组在会计上留下了一个关键尾巴——

第一步(2024):Cerebras 和 G42 签了一份远期股权预付合同,G42 提前付了 4.01 亿美元,约定未来按某价格换 Cerebras 股权。这笔钱进了 Cerebras 账上,但因为还没正式换成股权,会计上记为"负债"(欠 G42 一笔股权)4.01 亿。

第二步(2025):G42 重组退出,这份远期股权合同被取消。按 GAAP,这笔 4.01 亿负债当中的 3.633 亿要被一次性记成"利得"——是会计纸面上的利得,没有任何现金流入流出。

第三步(账面效果):这 3.633 亿非现金会计收益直接抬高了 2025 GAAP 净利润,让 Cerebras 从经营层面持续亏损(-1.46 亿)的状态,账面上变成净利润 +2.38 亿"看起来转正"。

一句话:2025 年的 GAAP 转正不是公司赚到了钱,而是一笔 2024 年欠下的"股权债"被勾销的会计结果。剥掉这个一次性非现金项目,2025 年经营层面比 2024 年亏得更多。

5、上市

预计本周四(5/14)上市,发行价已经连续上调,5/10 Reuters 报道再次上调至150~160,发行 3000 万股,募资额从 35 亿提升到 48 亿。按 $160 上限计算,完全摊薄市值最高约 488 亿美元(基础流通股口径约 340 亿),20 倍超额认购,一周内两次上调发行区间。这是一个散户火热、上市前已经加了溢价的项目。

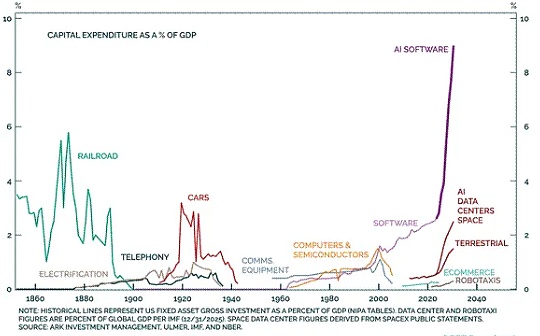

时机本身也不是巧合——SpaceX 的 IPO 预计在 2026 下半年开始密集筹备,Cerebras 在这之前抢着上,部分意图就是要拿到这一波"AI 基础设施 + IPO 窗口期开放"的稀缺定价。

二、技术:它靠什么做生意

1、把一整片晶圆做成一颗芯片

Cerebras 的做法是把 12 寸圆形硅晶圆直接做成一整块芯片,不需要中间再连接,数据全在一起。这件事专业上叫"晶圆级整合"。

具体的对比:WSE-3 的 44 GB SRAM 是直接做在晶圆上的片上内存,而 H100 主要依赖外部 HBM。两者不是同一种存储——H100 也有片上 cache,但只有 50 MB 级别。Cerebras 的优势不是"总显存更大"(44 GB SRAM 实际比 H100 的 80 GB HBM 还小一半),而是把大量高速 SRAM 和计算核心放在同一片晶圆里,减少了搬运距离。

若拿 WSE-3 的片上 SRAM 带宽(21 PB/s)与 H100 的 HBM 带宽(3.35 TB/s)相比,前者数量级高出约 6,000 倍。但这是不同存储层级的比较,不能直接等价为实际推理速度优势——实测速度差距远小于带宽比。

2、它的解决方案

我们和 AI 聊天,比如问"我怎么才能赚更多钱",背后发生两件事。

第一件叫 prefill——模型读懂这句问题。这一步可以并行运算,吃的是算力本身。

第二件叫 decode——模型一个字一个字把答案吐出来。下一个字必须等上一个算完才能开始,没法并行。所以我们看到 AI 是一个字一个字往外打的。而且每吐一个字,模型都要把全部参数从头读一遍。

可以把大模型想成一本巨厚的规则书。在 GPU 架构里,这本书放在 HBM 高速显存里,GPU 负责计算,每生成一个 token 就要从 HBM 读取大量参数。HBM 已经很快,但模型太大、读取太频繁——GPU 很多时候不是算力不够,是等数据从显存搬过来。

Cerebras 的路线,就是把计算核心和片上 SRAM 做进同一整片晶圆里,减少这一路上的数据搬运距离。

GPU 是"厨师很强,但调料还要不断从高速货架上搬过来";Cerebras 是"把更多调料直接放到厨师手边"。这就是它在低延迟 decode 场景里能跑得更快的底层原因。

3、主要优势

Cerebras 的硬件优势集中在一句话——低 batch、低延迟、高价值推理。

Cerebras 的优势在于所有东西都在一块晶圆上,但很明显,一块晶圆上的内存还是有上限的,如果模型超过了这块板上的内存,优势就缩小了。第三方机构 Artificial Analysis 实测的数据:把 Cerebras 和 NVIDIA DGX B200 进行速度测试,如果是 Llama 3.1 8B 的小模型,全放在芯片上,速度优势高达 18-36X;但如果是 400B 的大模型,需要走通信成本,就只有 2.4X。

所以,模型越小,Cerebras 的优势越大;模型越大、越要走外部 DRAM 流式加载权重,优势被通信吃掉。

另外是看 batch。batch 本质上是拼单,多个用户请求一起计算、一次读取模型参数。拼单越充分,GPU 的单位成本越低,Cerebras 的低延迟优势就会被稀释。batch 越大,GPU 越能追回来。

对应到产品策略:

GPU 适合高并发、低成本的大众推理

Cerebras 更适合编程助手、AI Agent、实时语音、金融研究这类"时间比算力更贵"的场景

GPU 是一次服务一大群顾客,Cerebras 是专门服务一个顾客——但只能服务那些高客单价的用户,否则会亏本。

4、服务模式:既做设计,又做整机,又做云

Cerebras 不是想这样,而是没办法。

WSE-3 一颗 12 寸晶圆做成的非标芯片,无法插进任何现有服务器机箱,需要专门设计的液冷、供电、机械支撑、网络互联,单台 23 kW 功耗是普通数据中心机柜的 5-10 倍。第三方服务器 OEM(Supermicro、Dell、HPE)那一整套围着 NVIDIA 建起来的标准化产业链,Cerebras 用不上。

所以 Cerebras 卖的是整机系统 CS-3,单台售价 200-300 万美元。

Cerebras 早期(2019-2023)尝试过一个路线:我卖整机,你自己部署。 卖给国家实验室、制药公司、UAE。客户拿回去自建机房,从签约到上线 6-12 个月,出货量始终上不来。客户嫌部署太重太难:23 kW 单机功耗、专门液冷、专门供电、专门机房布局,加上 CUDA 用不了、模型要重新编译,一颗非标芯片要把客户的整个 IT 基础设施改造一遍。

2023 年起 Cerebras 把商业模式改了:在自己的数据中心部署好,把推理算力按 token 卖出去。客户不用买硬件、不用改数据中心、不用学新工具链。模式跑通了,2025 年云服务收入 1.516 亿美元、同比 +93.58%。OpenAI 200 亿合同也是按这个模式签的——OpenAI 不买任何硬件,Cerebras 自己建数据中心、自己运营 750 MW 算力,以"算力即服务"卖给 OpenAI。

这套结构代价是 Cerebras 不只是芯片公司,它同时是整机集成商 + 数据中心运营商 + 推理云服务商。从台积电拿晶圆,到客户用上推理服务,中间四个环节全部要自己一家做。NVIDIA 把整机集成、数据中心部署、运营这些"重活"外包给了整个产业链,自己只做设计 + CUDA + 系统级 IP。

所以: NVIDIA 75% 毛利率、55% 净利率; Cerebras 39% 毛利率、经营层面持续亏损。 本质上就是这两条商业路径的差异在数字上的反映。

这件事也直接影响产能扩张速度。NVIDIA 背后是整个数据中心产业链在扩张——Supermicro 做整机、AWS/CoreWeave 建数据中心、Equinix 接入电力,每个环节都有专门的公司在干;Cerebras 则要自己把晶圆、整机、液冷、供电、数据中心和云服务串起来。前者是生态扩产,后者是公司级工程交付,速度天然不同。

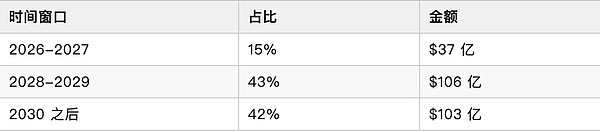

这就是为什么 Cerebras 招股书里那 246 亿美元"已签合同、但还没确认收入"的金额,其中 85% 要到 2028 年之后才能真正变成营收。从先进制程产能、整机集成、液冷机房到电力接入,任何一个环节延误,都会影响交付节奏。这里的瓶颈不是订单意愿,而是工程排队。

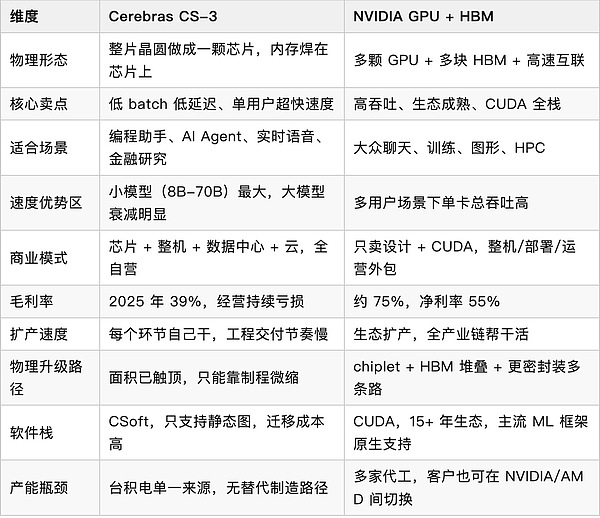

Cerebras 方案 vs NVIDIA 方案对比

Cerebras 是"小批高速专车",NVIDIA 是"大巴公交全网"。两条路线在物理上长期并存,但 Cerebras 的供给侧物理天花板把它的产业份额锁在极小的量级。这反过来意味着 GPU + HBM + 光互联这条主流路径在未来 5 年内不会被它系统性替代,HBM 三家、光互联龙头、台积电先进封装产能,Cerebras 上市本身不构成结构性利空。

这是一道"两条路线长期并存"的命题,不是"谁吃掉谁"的命题。

5、技术劣势:晶圆物理天花板

晶圆级方案有三个绕不开的根本短板。

第一是容量限制。最新的 WSE-3 单片只有 44 GB 片上 SRAM,装不下 70B 以上的全精度模型。要跑 405B、671B 这种大模型,Cerebras 的方案是把多台 CS-3 串成集群,大约 45 台 CS-3 装下一个 1 万亿参数模型。但代价是单台速度优势在跨多台机器后会被通信开销吃掉一部分,在小模型上 15 倍优势,跑超大模型时被压到 3-5 倍。

这直接影响 OpenAI 在 Cerebras 上跑什么——前沿大模型完整版目前还是只能跑在 GPU 集群上,也就是说 Cerebras 并不是英伟达的全方面挑战者,只能挑战其中一部分。

第二是面积已经触顶。WSE-3 的 46225 mm² 基本填满了 300mm 晶圆的有效使用区域,已经接近 EUV 光刻设备的物理极限——未来代际改进只能靠制程节点微缩(5nm → 3nm → 2nm),无法再通过扩大芯片面积来增加算力。

对比 NVIDIA 是个长期劣势:NVIDIA 可以通过 chiplet(B200 已经是双 die 拼接)、HBM 堆叠(HBM3 → HBM4)、更密集的封装继续在物理层面"加东西"。Cerebras 只能等更先进的制程。从 WSE-3 到 WSE-4,预计晶体管密度提升 1.5-2 倍,但物理面积不变——这意味着代际改进幅度会显著低于 GPU 阵营每 18-24 个月一次的代际跃迁。

第三是在 Agent 推理中会吃亏。其软件栈只支持静态图,不支持动态形状。90 万个 PE 核心的物理放置和路由配置在编译时就要确定,运行时无法重新配置。这意味着有三类工作负载在 Cerebras 上是被排除的——变长序列处理、条件执行/数据依赖分支、动态批大小。

这三类正好是当前最热的"智能体推理工作流"(agentic inference)的核心特征。AI 智能体一次任务要执行多步推理、动态决定下一步调不调用工具、上下文长度随对话扩展,都需要动态图。Cerebras 在"高速度但路径固定"的工作负载(编程辅助生成、批量推理)上发挥最好,在"灵活智能体"工作负载上反而比 GPU 受限。

三、生意赚钱吗

1、OpenAI 一张 200 亿美元的合同

Cerebras 这次 IPO 的焦点就是 OpenAI 这张合同。

它把 Cerebras 从"高度依赖 G42 一家客户"的故事,重写成了"OpenAI 战略推理合作伙伴"的故事,8 个月内估值从 80 亿翻到约 488 亿(完全摊薄)。

合同正式签订是 2025 年 12 月 24 日(主合作协议 MRA),公开披露是 2026 年 1 月 14 日。签约到首次交付只隔 30 天——2026 年 1 月 23 日就开始向 OpenAI 交付算力,说明合作早在 2025 下半年就在并行准备。

合同结构分四层——

第一层是基础合同。OpenAI 承诺采购 750 MW 推理算力,按 2026、2027、2028 三年分批交付,每个 tranche 服务期 3 或 4 年,可延长至最多 5 年。基础合同价值 100 亿美元以上。

第二层是扩展选项。OpenAI 有权在 2030 年底前再加 1.25 GW,使总规模达到 2 GW。扩展后合同总价值超过 200 亿美元。

第三层是 OpenAI 给 Cerebras 的 10 亿美元营运资本贷款。利率 6%,贷款期限不晚于 2032 年 12 月 31 日。但如果 Cerebras 按时交付算力,利息可以用算力交付来抵充——本质上是"OpenAI 借钱给 Cerebras 买台积电晶圆,然后用算力服务来还"。

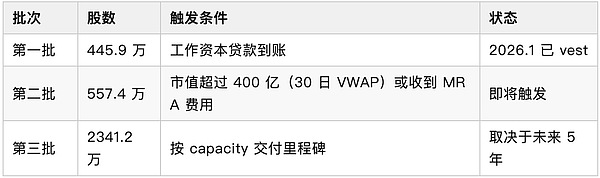

第四层是认股权证。Cerebras 向 OpenAI 发行最多 3344.5 万股 Class N(无投票权)股票的认股权证,行权价 $0.00001/股(基本为零)。Vesting 分三批——

如果两个里程碑都达到,OpenAI 最终持有 Cerebras 约 10% 股权。这降低了 OpenAI 中途撤单的概率,但同时意味着——OpenAI 在 Cerebras 估值故事里既是客户、又是债主、又是潜在股东。

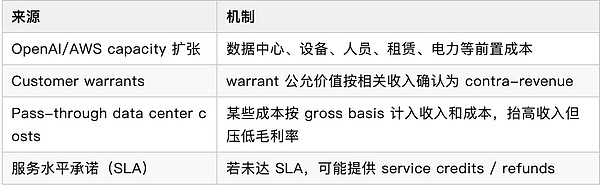

上面的做法,还需要一些会计上的考虑,这里用个比喻来帮助理解:你开店,给大客户白送了 10% 股权换长期采购合同。按 GAAP,未来这位大客户每给你打 100 块货款,账上不能记 100 块收入,要先扣掉一部分作为"白送股权的成本摊销",比如记 88 块。这扣掉的 12 块就是所谓 contra-revenue。但扣掉的钱是会计机制,不是经营恶化。OpenAI 真金白银付的钱没少,Cerebras 真实现金流没受影响。

但报表上的"收入增长率"会被这个机制人为压低。S-1/A 中管理层的明确预警——从 2026 年 Q1 起,warrant 形成的 contra-revenue 会开始进入财报,导致季度收入增长率比近期趋势下降。这是公司自己的官方信号,所以首份季报(约 2026.8 公布)大概率会出现"收入增速明显低于预期"的情形,市场如果没准备好,会有波动——届时正好是第一批解锁的日期附近。

在 IPO 路演中,还有一件事被传播:OpenAI 几位核心成员本身就是 Cerebras 的个人股东。2026 年 5 月 4 日 Brockman 出庭作证时承认,他自己是 Cerebras 个人股东;同时披露 Sam Altman 也独立投资了 Cerebras。Brockman 在 2017 年游说 OpenAI 收购 Cerebras 时持有 Cerebras 股权但未向当时还在 OpenAI 董事会的 Musk 披露。这段证词不会直接影响合同执行,但会让公开市场投资人在估值之外多一个治理变量要单独评估。

2、Codex-Spark——实战成绩单

2026 年 2 月 12 日,和 OpenAI 合作的第一个产品 GPT-5.3-Codex-Spark 上线,这是 OpenAI 第一个跑在非 NVIDIA 硬件上的生产模型。

主要参数:

在 WSE-3 上跑出 1000 tokens/秒以上——相比标准 GPT-5.3-Codex 跑在 GPU 集群上的 65-70 tokens/秒,快了 15 倍

仅向 ChatGPT Pro($200/月)订阅用户开放,API 价格未公布

模型是从标准 GPT-5.3-Codex 蒸馏出的小模型,能力有损失:SWE-Bench Pro 上 Spark 约 56% 对 Codex 5.3 约 56.8%(接近持平),但 Terminal-Bench 2.0 上差距明显,Spark 58.4% 对 Codex 5.3 77.3%

对 Cerebras 估值分几层:

第一层是速度真的兑现了。1000 tokens/秒在 GPU 推理服务上是做不出来的。这是 Cerebras 价值最大的背书之一。

第二层是物理层和实际层的鸿沟。内存带宽上 WSE-3 和 H100 数量级差 6,000 倍以上,但实测 token 生成速度只有 10-15 倍差距。中间几百倍差距被软件栈、batch 处理、工作负载这些系统级因素吃掉了。纸面参数翻译到实际推理速度时要打很大折扣。

GPU 阵营有一个反驳论点:认为这些速度对比都是单用户速度(per-user throughput)。GPU 在多用户场景下可以通过 batching 把若干用户请求合并、共享一次权重读取,单用户慢,但 batch 10-20 时单颗 H100 的总吞吐量可能就接近一台 CS-3。Cerebras 至今没公布 batch 128+ 高并发的总吞吐数据。

这意味着 Cerebras 适合"低并发 + 低延迟",不适合"高并发 + 高吞吐量"。后者 GPU 单位成本仍占优。

第三层是模型大小的硬约束。Spark 是蒸馏后的小模型,在更考验复杂任务推理的 Terminal-Bench 2.0 上损失明显。OpenAI 选择"专门为 Cerebras 蒸馏一个小模型",而不是把完整大模型拆到多台 Cerebras 机器上跑,说明后一条路径目前还撑不起前沿大模型。Cerebras 至少在当前一代硬件上,被锁定在"中小模型 + 高 ARPU 场景",前沿大模型完整版仍要 GPU。

第四层是成本悬念。Codex-Spark API 价格至今没公开,只通过 ChatGPT Pro $200/月订阅捆绑。如果 Cerebras 硬件真的便宜过 GPU,OpenAI 没理由不公开 API 定价——延迟披露这件事本身就在透露 cost-per-token 还没真正击穿 GPU 推理的成本曲线。Cerebras 在速度上是赢家,但在单位成本上是否便宜过 GPU,目前还没有公开数据可以验证。

总结:有亮点,但香不香,见仁见智了。

3、AWS:分销渠道,不是客户

2026 年 3 月 13 日,AWS 宣布与 Cerebras 多年合作,计划在 AWS 数据中心部署 CS-3,并通过 Amazon Bedrock 向客户提供高速推理。

合作的核心架构叫分离式推理(disaggregated inference):

Prefill 阶段(吃掉用户上下文、生成第一个 token)用 AWS 自研 Trainium,计算密集型

Decode 阶段(逐个 token 往外吐)用 Cerebras CS-3,内存带宽密集型

两段之间用 AWS Elastic Fabric Adapter(EFA)高速网络互联

一个重要细节是:AWS 合作目前仍是 term sheet,不是定稿合同。S-1/A 明确披露——term sheet 中 pricing、exclusivity、minimum capacity 及 AWS 保护条款具有约束力,包含初始多年度租赁,但双方仍需谈判并签署最终协议。市场把它当成已落地的合同来定价,实际仍处于"高度可能但未完全锁定"状态。

AWS 也获得了最多 269.7 万股 Class N 的期权,行权价 $100/股(注意这里和 OpenAI 的近零行权价完全不同),vesting 与超出初始 lease 的购买量及其他触发条件相关。

好的一面:Cerebras 不再"全栈挑战 NVIDIA / Trainium",而是接受了"特定环节最优"的定位,降低了 AWS 与 Cerebras 的正面冲突,让 AWS 反而有动力推 Cerebras 进 Bedrock 渠道。

需要看清楚的另一面:这套架构把 Cerebras 的定位进一步具体化——它最强的地方是 decode 阶段的低延迟高速输出,而不是覆盖推理全流程的通用平台。Cerebras 在产业链中的位置正在从"AI 推理平台公司"被向下定位为"高速 decode 加速器",估值故事的边界被悄悄收紧。后者比前者的市场要小一个数量级。

而且要注意,AWS 不是 Cerebras 的客户,而是分销渠道。这一点在估值上和 OpenAI 的直接采购很不一样。

4、客户结构

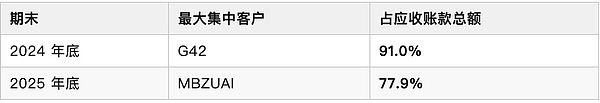

Cerebras 的客户故事一直绕不开 G42,这家阿布扎比的 AI 公司从 2023 年起就是 Cerebras 最大的客户,2024 年第一季度占营收 87%。

2025 年开始,Cerebras 试图把客户故事讲得更分散:24 年 G42 占比 85%,其他 15%;25 年 G42 降到 24%,但 MBZUAI 又上升到 62%,其他 14%。在会计算法上,这是两个独立客户;但在商业意义上,其实还是一回事——G42 的集团 CEO Peng Xiao 同时是 MBZUAI 董事会成员,两家在 UAE 国家战略框架里都是 AI 战略执行实体,实际付钱方都是 UAE 国家资本。

更危险的数字是应收账款(AR)集中度——

应收账款是"已经出货但还没收到钱"的部分。AR 集中度比收入集中度更危险,任何一家客户延迟付款都直接冲击现金流。UAE 国家资本付款节奏不完全可控,主权 AI 项目预算执行受地缘政治、监管、政治周期影响。如果 MBZUAI 突然推迟付款 6 个月,对 Cerebras 现金流的影响接近一次小型流动性危机。

除 OpenAI 和 UAE 两家,Cerebras 招股书披露的其他客户包括 Meta(Llama API 合作)、IBM、Mistral、Cognition、AlphaSense、Notion、LiveKit、GSK、AstraZeneca、Mayo Clinic、美国能源部、美国国防部、TotalEnergies。清单广度够,但 2025 年实际营收里这些客户合计只占 14%。从 2026 年开始 OpenAI 会逐步起量,但 OpenAI 的全部收入要到 2028 年之后才能完整确认。

也就是说,2026-2027 这两年,Cerebras 的实际营收仍然会高度依赖 UAE 两家关联实体。

5、美国本土客户萎缩 34%

招股书中有一点应该注意,美国本土账单收入从 2024 年的 2.827 亿美元下降到 2025 年的 1.876 亿美元,下降 34%(见 S-1 geographic billings breakdown,PitchBook、Futurum 等多家媒体的招股书拆解均引用了同一数据)。同期总营收增长 76%。

Cerebras 2025 年的增长完全来自国际客户(主要是 UAE 加上 OpenAI 合同的预付款部分),美国本土客户基础不仅没扩展,反而在收缩。

一个"挑战 NVIDIA 的美国 AI 芯片公司"在自己本土市场的客户基础在萎缩,这和它讲的故事是有点别扭的。

四、财务细看

截至 2025 年底,Cerebras 全公司只有 708 名员工。这个数字按完全摊薄约 488 亿美元估值倒推,人均估值约 6900 万美元,远高于 NVIDIA 和 AMD 的水平。这不是一个"传统硬件公司"的人头比,更接近"软件 + IP 公司"的形态。

但反差的另一面是,这家 700 人的公司要在未来 3 年里建设服务 OpenAI 750 MW 推理算力的数据中心、整机集成、运营客户云、维护软件栈,每个环节都自己来。这个团队规模 vs 工程任务规模的不匹配,是预售合同兑现风险的人力侧具体体现。

1、收入增长是真的

营收年度增长:

25 年这 5.1 亿美元中:

硬件销售 3.584 亿美元(70%,同比 +69.1%)

云及其他服务 1.516 亿美元(30%,同比 +93.6%)

云收入占比快速上升,反映 Cerebras 从"卖系统硬件"向"卖推理算力"商业模式的转变。硬件和云同时增长,并不是"硬件卖不动才被迫做云"。

2、毛利率塌方

把全年毛利率拆开看,2025 年波动其实非常大:

Q2 毛利率显著低于其他季度(31.1% vs 平均 41%),不是小波动,是 10 个百分点的塌方。原因公司没有具体披露,但说明收入 mix、数据中心成本、服务成本和合同结构会造成 10+ 个百分点的毛利率波动。

公司在 S-1/A 中的明确提示——"未来近期毛利率可能因 cloud capacity 启动成本而显著低于近期水平"。

压力来源有四个:

3、净利润:GAAP 转盈的真相

招股书上 2025 年 GAAP 净利润细看:

注:部分媒体报道的89.7M净利润是2025年Q4单季度数据,全年GAAP净利润为237.8M。

几个关键点——

第一,账面 GAAP 的盈利是虚的。2025 年 +2.38 亿利润里,有 3.63 亿是 G42 那笔股权债被勾销的会计利得,没有任何现金流入。剥掉这笔,经营层面比 2024 年亏得更多。

第二,经营现金流从正 4.52 亿掉到负 0.1 亿,看着吓人,但不是恶化。2024 年那 4.52 亿是 G42 一次性付的 3 亿预付款撑起来的,2025 年预付款用完,现金流自然回到近零,倒是正常节奏。

第三,真正在烧钱的是数据中心。2025 年资本开支 3.83 亿,几乎全砸进 OpenAI 那 750 MW 产能建设。自由现金流(经营减资本开支)从 2024 年正 4.29 亿翻到 2025 年负 3.93 亿——这才是钱实际流出去的方向。

总结:账面转盈是化妆,真实状态是经营亏损在扩大、大笔现金正在涌向数据中心。

4、股东权益为负:不上市没钱了

2025 年底有一个数字特别醒目:股东权益是负 5.79 亿美元。

股东权益为负,意味着公司账上欠的(累积亏损 + 优先股回购义务)已经超过股东投进去的钱。这不一定是灾难——很多 IPO 前公司都长这样,但它说明一件事:这场 IPO 不是锦上添花,是必须要做。

IPO 募到 48 亿(扣完承销费净进 46 亿)之后,账面立刻改写——

也就是说,IPO 一上市,资产负债表就从"病人状态"修复成"正常公司"。这也解释了 2026 年 4 月那笔 8.5 亿美元循环信贷,一家轻资产芯片设计公司不会同时要 IPO 融 48 亿 + 银行借 8.5 亿,Cerebras 在融资轨迹上已经完全变成了"重资产基础设施公司"的样子。

5、246 亿美元合同,85% 要到 2028 之后

Cerebras 招股书中 246 亿的合同很亮眼。截至 2025 年 12 月 31 日,剩余履约义务(RPO)246 亿美元——已经签约但还没确认收入的合同总额。这个数字相对于 5.10 亿美元年收入,在硬件行业是惊人的,更接近国防承包商或 SaaS 龙头的特征。

但确认节奏是这个故事的关键变量:

85% 的 RPO 要到 2028 年之后才能转化为营收。真正"营收兑现"的时间窗口是 2028-2029,不是 2026-2027。前两年仍处于"建设期 + 部分确认 + UAE 客户主导"的状态。

而且 RPO 不等于"必然变成现金"。招股书风险章节说,如果 Cerebras 无法按时交付 OpenAI 合同的算力,OpenAI 有权终止合同,不仅未来收入消失,10 亿美元贷款的还款义务也会被触发。246 亿美元 RPO 的兑现质量高度依赖于 Cerebras 的工程执行能力——按时建数据中心、按时部署 CS-3、按时把硬件转化为可用算力。

这不是会计层面的不确定性,是工程层面的不确定性。

五、估值

对于这样一家公司,全新的物种,叙事高分,但未来的工程交付、业务实现等都面临不少挑战。不如不去算公司值多少,而是去算:市场当前按完全摊薄 488 亿、基础市值约 340 亿这个口径给的估值,等于在押注什么?

1、几种反推

按市值/收入(用完全摊薄约 488 亿):

给 NVIDIA 同样的 24× P/S,隐含 2026 收入要做到约 20 亿美元

给 AMD 同样的 20× P/S,隐含 2026 收入要做到约 24 亿美元

给一般高增长云软件 15× P/S,隐含收入约 32 亿美元

按 2025 trailing 收入 5.10 亿美元算,市场给的是 2025 年 96× P/S(完全摊薄)。这个倍数本身已经远超主流半导体可比公司,对标的更接近 IPO 阶段的 Snowflake 或 Palantir。

按市值/合同:

完全摊薄 488 亿 / 246 亿 RPO ≈ 2.0×

但 RPO 兑现质量取决于工程能力,OpenAI 在 MRA 中保留终止权

2× 在 SaaS 行业属于偏高、在国防承包商已经偏贵——Cerebras 在中间,更靠近哪一边由后续季报和交付里程碑决定

按"OpenAI 单一合同折现":

假设 OpenAI 750 MW 全部兑现 + 1.25 GW 选项行权 = 2 GW,按当前推理算力市场价折算约 200-500 亿美元终值(区间宽,取决于 2030 年单 MW 算力市场价)

488 亿完全摊薄估值意味着,市场不仅押注 OpenAI 这单完整兑现,还预期 Cerebras 能再拿下一个同等量级的客户

2、未来 18 个月的关键里程碑

每个里程碑触发显著的估值重定价——

六、其他风险

1、CUDA 生态护城河

最大的产业级风险是 CUDA。NVIDIA 用 15+ 年时间建立的开发者生态——PyTorch、TensorFlow、JAX 等所有主流 ML 框架都原生支持 CUDA,数百万 AI 工程师习惯了 CUDA 工具链。

Cerebras 的软件栈(自己的编译器和 SDK)和 CUDA 不兼容。每次客户从 GPU 迁移到 Cerebras,本质上是一次软件栈重写。这不是"硬件性能就赢了"的简单切换,是"软件团队要重新学一套工具"的重大决策。

对 OpenAI、Meta 这种有专门工程团队的客户,这个迁移成本可以吃下;对绝大多数中小企业客户,这个成本就是"算了还是用 GPU 吧"。

2、NVIDIA 的反击节奏

NVIDIA 的 Blackwell B200(2024 年底-2025 量产)推理性能比 H100 快约 2 倍;Rubin R200(2026 下半年量产)HBM4、22 TB/s 内存带宽;Rubin CPX(同期)专门用 GDDR7 处理推理的第一阶段。

更关键的是 NVIDIA 自己也在用 Groq 的技术——2025 年 12 月 24 日 NVIDIA 花了大约 200 亿美元现金收购 Groq 资产 + 非独家技术授权,CEO Jonathan Ross 和总裁 Sunny Madra 等核心团队加入 NVIDIA。这是 NVIDIA 32 年来最大的单笔交易,超过 2019 年 69 亿美元收购 Mellanox。

Jensen Huang 在 2026 年 3 月 GTC 主旨演讲上明确说:"如果你的工作负载主要是高吞吐量,我会全部用 Vera Rubin;如果工作负载是编程和高价值工程 token 生成,我会加入 Groq,大约占数据中心的 25%。" 同时发布的 Groq 3 LPX 整机机柜将与 Vera Rubin NVL72 并列部署,预计 2026 Q3 出货。

Cerebras CTO Sean Lie 在去 GTC 边会的 Uber 上听到这段后说"这对 Cerebras 简直是最好的事"——理由是 Jensen 等于承认"GPU 在 400-600 tokens/秒区间跑不动,因为内存带宽不够,必须靠 SRAM 密集的架构补"。这件事是双向的:一面 NVIDIA 公开承认 GPU 单一架构覆盖不了高速推理,某种意义上成了 Cerebras 路线的外部背书;另一面 NVIDIA 已经把 Groq 团队和 IP 吃进自己产品体系,意思是它要把这块市场自己拿下。

3、OpenAI 履约 + 自研芯片双重风险

OpenAI MRA 包含 capacity 交付里程碑、服务水平承诺、数据中心部署要求和潜在终止权。如果公司无法按期交付,OpenAI 可能终止部分或全部协议,是潜在的现金流爆炸点。

更远一层风险——OpenAI 自己在做几件事:

和 AMD 签了多年协议(2025 年 10 月),锁定大量 MI455X 算力

和 Broadcom 合作设计自己的 ASIC 推理芯片(预计 2026 下半年-2027 流片)

和 Amazon 签了 380 亿美元算力服务协议(2025 年 11 月)

下单台积电 5nm/3nm 流片自己的 AI 芯片

OpenAI 既是 Cerebras 最大的客户,也是 Cerebras 最可能的替代者。如果 OpenAI 自研芯片在 2027-2028 年成功,完全可能把 Cerebras 的 2 GW 选项放弃,只交付基础 750 MW。

4、台积电单一来源

公司依赖台积电等第三方 foundry,且属于集中/sole-source。Cerebras 的整个功能单元是一片连续完整晶圆,若 TSMC 出现产能问题、生产中断或地缘政治约束,不存在替代制造路径——与 GPU 客户可在 NVIDIA、AMD 之间切换不同。

5、治理风险

Cerebras 设计了三类普通股——Class A(IPO 公开发行)1 票/股、Class B(早期投资人和创始人)20 票/股、Class N(OpenAI 认股权证对应)无投票权。IPO 完成后,Class B 股东合计将控制约 99.2% 的投票权。Andrew Feldman 在 IPO 后持有约 1,030 万股,IPO 中不出售。

这种"高投票权超级股"结构对二级市场投资人意味着——即使散户买了 Cerebras 全部 Class A,对公司战略的影响力也接近于零。如果创始人决定派息、回购、收购、出售公司,二级市场股东无法反对。

OpenAI、AWS、G42、员工等都有期权,将来可能稀释,完全摊薄股本可能比基本流通股本高 30%+,这会冲击长期股权回报。

七、上市机制与解禁节奏

1、IPO 配售为什么散户拿不到

5 月以来 X 平台已经有大量用户反馈在 Robinhood、SoFi、Webull 等平台看不到 CBRS 的 IPO 配售。这不是 Bug,是 IPO 教科书级现象。

20 倍以上超额认购意味着每 100 股需求只有不到 5 股供给。承销团(Morgan Stanley 主导)会优先分给三类账户——长线机构(共同基金、养老金、主权基金)、对冲基金、Cerebras 的私募投资人和关系户,以及大额经纪客户(Fidelity 通常要100K-500K 资产门槛)。

零售经纪商的 IPO 池子本身就极小。即使 Robinhood、Public.com、SoFi 这些平台拿到了配售,可能只有几十万到几百万股要分给数百万账户,多数账户结果就是"未中签"。

5/5 公告 CBRS 要求 IPO 买家用限价单——这是承销团在主动过滤纯投机散户。但反过来,这也意味着开盘价的形成机制更不透明,因为限价单堆积的位置由少数大户决定。

2、真实流通量极小——控盘式 IPO

按 $160/股上限定价、约 488 亿美元完全摊薄市值倒推,外面人能买到的真正只有不到 12% 的全部股份。剩下 88% 在内部人、Tiger Global、Benchmark、AMD、Coatue、Fidelity、Feldman 自己(1,030 万股不卖),以及 OpenAI/AWS 的 warrants 手里——这些全部受 180 天锁定期约束,到 2026 年 11 月 14 日前后才能流通。

所以开盘已经变成一个投机博弈:

20×+ 超额认购 = 至少 ~600M 股的需求追着 34M 股的供给跑

机构吃下的部分还会进一步锁仓——拿到 IPO 配售的长线基金通常不会在第一天卖

真正进入市场流动的可能只有 1,500-2,000 万股(机构留一部分、做市商占一部分、套利盘占一部分)

限价单要求排掉了纯打板散户,但反过来意味着开盘价由谁挂限卖单决定——挂得高、又没人卖低,价格就一路上行

这就是 Arm 2023 年 9 月当年同样的剧本——SoftBank 保留 90% 股份,浮动盘 ~10%,首日 +25%。控盘式 IPO 的物理学就是这样。

3、六个月锁定期到期日

2026 年 11 月 14 日前后锁定期到期。早期 VC(Benchmark、Foundation Capital、Eclipse、Coatue)、Tiger Global、员工 RSU 在这一天获得抛售权。历史上控盘式 IPO 在锁定期到期前后常常有 -20% 到 -40% 的回调。

早期投资人的获利动机是高度不对称的——这是 11 月解禁压力的真正来源。各轮投资人按 $160 上限计算的账面收益倍数:

一句话——A/B/C 轮投资人解禁日卖一股就是上百倍利润,公开市场买入的人连利润都没有就在被砸盘。

真正会在 11/14 day 1 出货的是谁——Benchmark、Coatue、Sequoia 这批 A/B/C 轮基金(账面 130-320 倍),加上 D 轮的 Altimeter(32 倍)。这些机构的标准操作就是解禁日卖 1/3 锁定收益,分批出货。后面 F/G/H 轮的回报倍数低,反而没那么急。

CEO Feldman 承诺不卖(1,030 万股,约 16.5 亿美元)——这是积极信号,但他不卖不代表 VC 不卖。

锁定期到期 7 天内可能解禁的股数是 IPO 发行规模的 5 倍以上,按 $160 算超过 270 亿美元等值供给。即使只有 20-30% 实际抛出,对仅 10-12% 浮动盘的 CBRS 来说也是巨大冲击。

拿不到配售的人,最友好的入场窗口是 8 月首份季报后,或 11 月 14 日锁定期到期之后,届时浮动盘从 10-12% 显著扩大,估值才真正"市场化"。

结语

Cerebras 这次 IPO 是公开市场对"NVIDIA 之外有没有真正的 AI 推理平台型公司"的第一次系统性表决。如果 CBRS 上市后能维持估值并持续兑现,会带动 Groq、SambaNova、Tenstorrent 这一批"非 HBM 推理芯片"公司的整体重估;如果回调严重,产业会回到"GPU 是唯一答案"的共识。

但 Cerebras 的供给侧物理天花板把它的产业份额锁在较小的量级,GPU + HBM + 光互联这条主流路径在未来 5 年内不会被它系统性替代。HBM 三家、Coherent / Lumentum 这类光互联龙头、台积电的先进封装产能,Cerebras 上市本身不构成结构性利空。

两条路线长期并存是确定的。对于 Cerebras 自己,IPO 之后才是真正的大考。

声明:本文由入驻金色财经的作者撰写,观点仅代表作者本人,绝不代表金色财经赞同其观点或证实其描述。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

史上第一家 Circle作为上市公司 直接发币 预售机构十分豪华

史上第一家 Circle作为上市公司 直接发币 预售机构十分豪华C Labs 加密观察

华尔街轮番推迟时点预期 今年美联储降息悬了?

华尔街轮番推迟时点预期 今年美联储降息悬了?华尔街见闻

Galaxy的去相关性检验

Galaxy的去相关性检验Block unicorn

拆解Circle Q1财报:利率红利退潮后 USDC准备下一盘大棋

拆解Circle Q1财报:利率红利退潮后 USDC准备下一盘大棋Odaily星球日报

Kraken收购Reap 买的不是亚洲 也不只是稳定币

Kraken收购Reap 买的不是亚洲 也不只是稳定币沙丘路的毛圈狮子

BTC迎来关键考验 本周需关注哪些大事件?

BTC迎来关键考验 本周需关注哪些大事件?区块链骑士

暴跌漩涡中 软件选择主动被大模型“吞噬”

暴跌漩涡中 软件选择主动被大模型“吞噬”腾讯科技

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部