DeepSeek这把枪 已经抵在硅谷后脑勺上

DeepSeek V4 发布后的几天,硅谷那边一直在发酵,也带来了几个更尖锐的问题讨论:模型效率、芯片格局、IPO 时点、开源对闭源的挤压。

4月29日,来自硅谷 101 的视频博客,请到芯片架构师肖志斌和前 OpenAI 研究员 Jenny Xiao,两人聊了一个多小时,把整件事彻底聊透了。

被开源超越,你的商业价值归零

对谈里最狠的一句话,是 Jenny 去年就提出的概念——kill line(死亡线),开源模型给闭源基础模型公司画的死亡线。

"If you're a foundation model company and you get surpassed by open source, the value of your business is essentially zero."

如果你是一家基础模型公司,被开源模型超越了,你的商业价值直接归零。

这不是技术竞争,这是生死线。

Jenny 拿 Anthropic 举了个例子:如果有一天 Claude 不再是编程最好的模型,谁还会用 Claude Code?

顺着这个逻辑,4月24日 DeepSeek V4 一发布,硅谷所有闭源公司的股价和估值都面临一个灵魂拷问:你的模型,现在还配卖这个价吗?

拿价格说话最直观:

GPT-5.5 比 GPT-5.4 贵了整整 2 倍,长文本Pro版本每百万 token 180 美元。

同一天,DeepSeek V4 发布。输入 1元/百万 token,输出 24元/百万 token。Flash 版更狠:输入 0.2元/百万 token,输出 2元/百万 token。

一个贵了两倍,一个便宜了十倍。

基础模型公司的估值是二元的——你的存在理由就是模型最强。一旦不再最强,估值直接归零。 哪怕你叫 OpenAI。

钱太多,反而不会省钱

Jenny 在对谈里戳破了一个硅谷不敢面对的真相:

"硅谷公司钱太多,反而没动力优化效率。中国模型厂商被资源倒逼,更早进入 token efficiency 创新。"

资源约束,反而成了创新加速器。

OpenAI 从第一天就信奉"move fast, break things",GPU 放开买,infra 疯狂建。Anthropic 反而克制,怕收入跟不上,被采购成本拖死。

结果呢?同等收入下,Anthropic 的资本效率显著高于 OpenAI。

更麻烦的是,OpenAI 同时在打硬件部门、自研芯片、购物 App 几条战线,核心 ChatGPT 体验反而没做好。从去年底开始,副线项目一批批砍,Sora 也在里面。

投资人心态彻底变了。以前看 AI 公司是"曲线还在指数增长,继续投钱"。现在问的是:

"再投 10 亿、100 亿,边际收益在哪?ROI 在哪?"

DeepSeek 给出的答案很直接:继续扩 infra 的 ROI,可能已经不划算了。

创新都是被逼出来的。便宜本身,就是技术革命的前提。

每一次工业革命,推动变革的不只是技术有多牛,还在于技术有多便宜。只有便宜到普通人用得起,技术才能真正改变世界。

没有效率,AGI 只能是个 demo

肖志斌读完 V4 论文认为:"方向意料之内,工程完成度意外。"

V4 所有的技术优化,其实都瞄准了同一个靶心——token efficiency(词元效率)。

它用了三把刀:

• Muon 优化器:部分训练模块替换掉传统 Adam,收敛速度进一步拉高

三件事合在一起,指向同一个结果:每个 token 的生成成本更低了,每次推理占用的内存更少了。

计算成本降到硅谷模型的1/3,内存占用只有 1/10。

但 V4 真正让人细思极恐的地方,远不止"省钱"这么简单。

Jenny 在对谈里反复提醒:Chatbot 时代,token 消耗有限,模型贵一点用户也能忍。但 Agent 时代完全是另一套逻辑——长任务拆解、多工具调用、反复反思和规划,token 消耗是 chatbot 的 10 到 100 倍。

如果每个 token 都价格不菲,模型就没法长时间深度思考,更不可能大规模服务用户。

所以她抛出了那句定调的话:

没有效率,AGI 只能是个 demo。有了效率,AGI 才能成为真正的产品。

到了 Agent 时代,效率本身就是智能的一部分。

Anthropic凭什么反超到1万亿?专注 > 什么都做

这段时间 Anthropic 估值反超 OpenAI,冲上 1 万亿美元。

Jenny 把原因列了三条,但本质就五个字:专注 > 什么都做。

第一,Claude Code。

为什么 Claude Code 是 Anthropic 的"定义时刻"?

Anthropic 的模型一直很好,但 Claude Code 才是真正驱动收入的那个产品。OpenClaw 创始人 Peter Steinberger 直接写了一篇文章:《Claude Code 就是我的电脑》。

一旦模型能写代码,就能做通用任务——更新 CRM、转发邮件、搭自动化流程,底层全是代码。

Jenny 的判断很锋利:编程是通向 AGI 最重要的一步。谁拿下编程,谁就可能成为 AGI 时代的主导玩家。

第二,企业信任。

Jenny 基金里的企业客户反复说同一句话:选 Anthropic,因为它有安全承诺。加上 Anthropic 起诉五角大楼那件事,企业接受了它传递的信号。

第三,不做多余的事。

OpenAI 想做"一个所有人的所有东西",结果战线分散,技术领先丢了。Anthropic 只打三条线:安全、企业、编程。

硅谷投资人认一个死理:企业收入优先于消费收入。 Anthropic 收入高度集中在企业,这恰恰是美国资本市场最爱的故事。

英伟达:短期安全,长期推理市场必然分化

说到芯片,目前都觉得 DeepSeek 在"去英伟达化"。

但实际情况要更细分。

训练阶段:DeepSeek V4 庞大体量的预训练,毫无疑问是在庞大的 NVIDIA 集群上完成的。V4 英文技术报告第16页,20页提到的 TCGenO5,以及 MegaMoE² 等关键算子,都是深度绑定 CUDA 生态的底层优化。

适配阶段:华为昇腾对外宣传的是"0-day适配续训练/推理",AMD 宣传的是"在 ROCm 上集成优化"。

注意一个关键措辞——"适配"。

这意味着,模型已经在 NVIDIA 集群上训练定型了。昇腾和 AMD 所做的,是在事后用自己的软件栈去"对接"这个已经训练好的模型。是后向兼容,不是原生替代。

从这个角度看,短期之内,英伟达在训练端的护城河比很多人想的要深。 CUDA 生态不是一两年能搬走的。

但长期呢?推理市场确实在松动。

V4 把长上下文 attention 成本打下来后,大规模推理的门槛大幅降低。推理不再是"谁卡多谁赢",而是"谁架构匹配谁赢"。Google TPU、AMD、云厂商自研芯片,甚至国产算力,都在这条线上找机会。

那个让硅谷失眠的"80/20"信号

Jenny 投资组合里有个数据:80% 的任务,跑在中小开源模型上。只有 20% 最复杂的任务,用到闭源模型。

往前推一年,没人会信这个比例。

现在硅谷每天都能刷到这种信息:"我们手里有 1000 万美元的 OpenAI 股票,你们基金在买吗?或者认识谁在买吗?"

4月29日那期硅谷101最后,Jenny 用一句话给整件事定了性:

"DeepSeek 像一把抵在硅谷模型公司背后的枪。这些公司如果跑得不够快,DeepSeek 会追上来,把它们的业务彻底摧毁。"

这把枪,已经上膛了。

声明:本文由入驻金色财经的作者撰写,观点仅代表作者本人,绝不代表金色财经赞同其观点或证实其描述。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

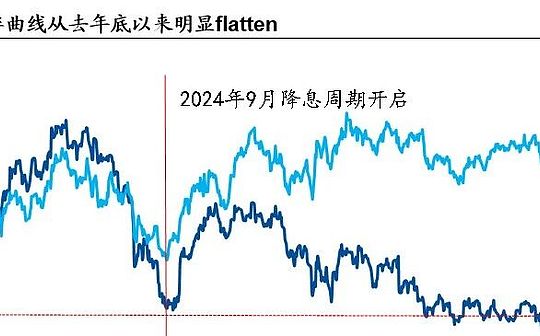

鲍威尔:漫长的告别

鲍威尔:漫长的告别GTJAI宏观研究

AI Token的价值逻辑、生态支撑与安全挑战

AI Token的价值逻辑、生态支撑与安全挑战数字新财报

链接真实世界资产:从协议族解析到安全实践

链接真实世界资产:从协议族解析到安全实践慢雾科技

DeepSeek这把枪 已经抵在硅谷后脑勺上

DeepSeek这把枪 已经抵在硅谷后脑勺上极思TopMinds

鲍威尔继续留任美联储理事 为对抗政治干预打破数十年惯例

鲍威尔继续留任美联储理事 为对抗政治干预打破数十年惯例RMB交易与研究

美联储的“断层线”

美联储的“断层线”周子衡

障碍、银行和突破

障碍、银行和突破Block unicorn

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部