速览2026年斯坦福AI指数报告

撰文:jsai@金色财经

2026年4月17日斯坦福大学HAI(Human-Centered AI)研究院发布2026年AI指数报告。这是迄今为止最全面的AI年度报告,共423页,涵盖研究与开发、技术性能、负责任AI、经济、科学、医学、教育、政策治理与公众舆论九大领域。

报告的核心主旋律可以用一句话概括:AI的能力在以令人眩晕的速度前进,而围绕它构建的评估体系、治理框架、教育制度和监管机制,都在艰难地追赶。

一、报告十大要点总结

1、AI 能力并未进入平台期,反而正在加速普及

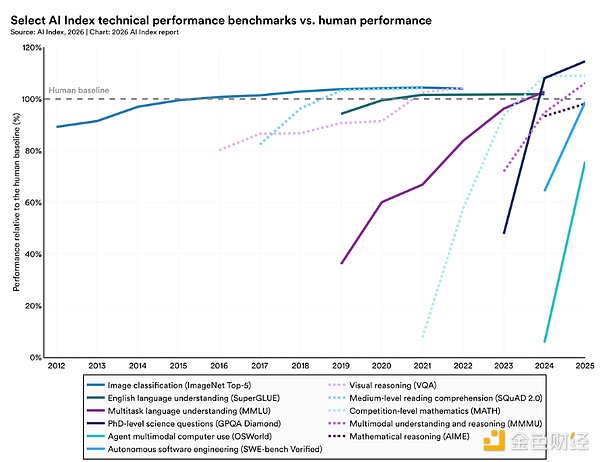

工业界在2025年产出了超过90%的顶尖前沿模型。目前,多个模型在博士级科学问题、多模态推理和竞赛数学方面已达到或超过人类基准。在关键编程基准测试 SWE-bench Verified 上,性能在一年内从60%飙升至接近100%。机构采用率达到88%,五分之四的大学生正在使用生成式 AI。

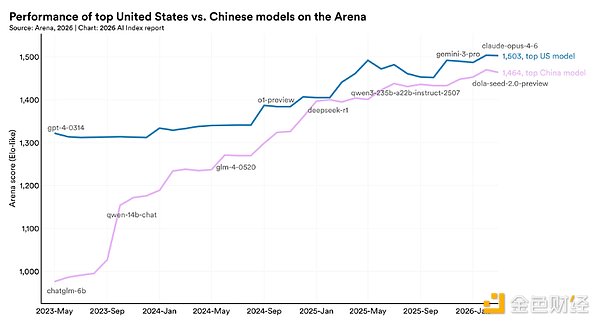

2、中美 AI 模型性能差距已基本消除

自2025年初以来,中美模型多次更替领先地位。2025年2月,DeepSeek-R1 曾短暂追平美国顶尖模型;截至2026年3月,Anthropic 的最强模型仅领先2.7%。美国在顶级模型数量和高影响力专利方面仍具优势,而中国在论文发表量、引用量、专利产出及工业机器人安装量上处于领先。韩国凭借人均 AI 专利数全球第一,展现出极高的创新密度。

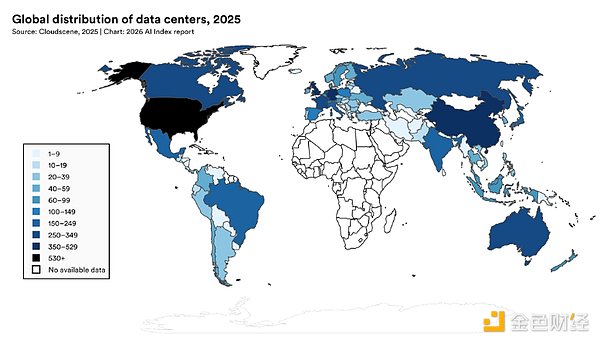

3、美国拥有最多的 AI 数据中心,但其多数芯片由一家台湾代工厂制造

美国拥有5,427个数据中心,是其他国家的10倍以上,能源消耗也居全球之首。台积电几乎制造了所有领先的 AI 芯片,这使得全球 AI 硬件供应链高度依赖台湾的这一家代工厂——尽管台积电在美国的扩建项目已于2025年投入运营。

4、AI 模型能赢得国际数学奥林匹克金牌,却无法可靠地辨认时间——研究者称之为 AI 的“崎岖前沿(Jagged Frontier)”

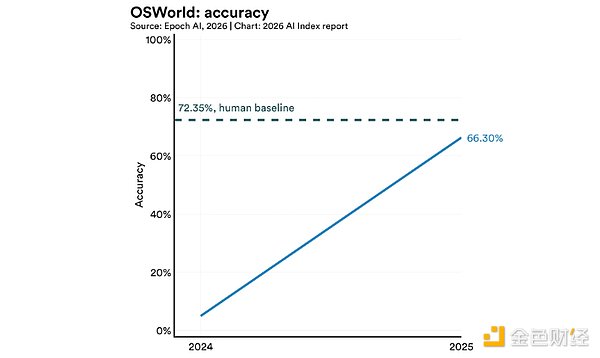

Gemini Deep Think 获得了国际数学奥林匹克竞赛金牌,但顶尖模型识别模拟时钟(指针表)的准确率仅为50.1%。在测试跨操作系统真实电脑任务的 OSWorld 上,AI 智能体(Agents)的任务成功率从12%跃升至约66%,但在结构化基准测试中仍有约三分之一的尝试以失败告终。

5、负责任 AI 的发展未能跟上 AI 能力的步伐,安全基准滞后且相关事故激增

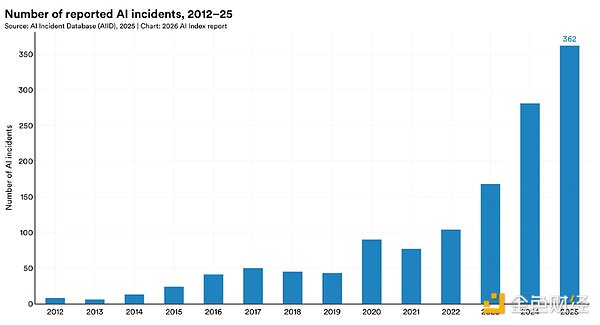

几乎所有领先的前沿 AI 开发商都会报告能力基准结果,但对“负责任 AI”基准的报告仍不完整。记录在案的 AI 事故从2024年的233起上升至362起。更具挑战的是,近期研究发现,提升负责任 AI 的某个维度(如安全性)可能会削弱另一个维度(如准确性)。

6、美国在 AI 投资领域领先,但吸引全球人才的能力正在下降

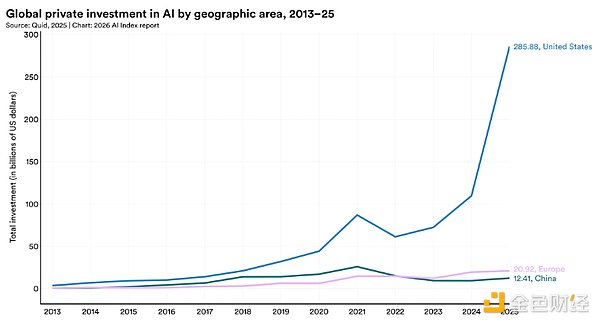

2025年美国私人 AI 投资达到2859亿美元,是中国的124亿美元的23倍多——但考虑到政府引导基金,仅看私人投资数据可能低估了中国的总投入。美国在创业活跃度上也处于领先,2025年新成立的获投 AI 公司达1,953家,是紧随其后国家的10倍多。然而,迁往美国的 AI 研究人员和开发人员数量自2017年以来下降了89%,仅去年一年就下降了80%。

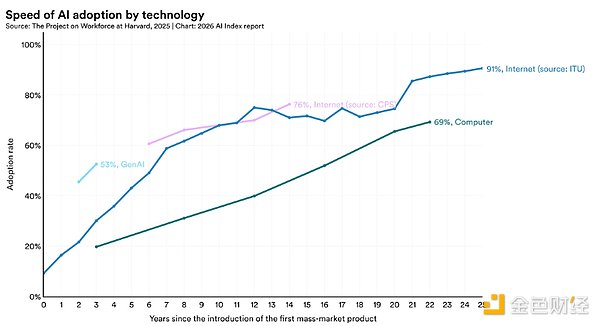

7、AI 的普及速度创下历史纪录,消费者正从通常免费的工具中获得巨大价值

生成式 AI 在三年内达到了53%的人口普及率,速度快于个人电脑(PC)或互联网。普及速度因国而异,且与人均 GDP 强相关。部分国家表现出超预期的高普及率,如新加坡(61%)和阿联酋(54%),而美国以28.3%排名第24位。到2026年初,生成式 AI 工具为美国消费者创造的年价值估计达1720亿美元,用户中位价值在2025至2026年间翻了两番。

8、正规教育落后于 AI 发展,但人们正在人生的各个阶段学习 AI 技能

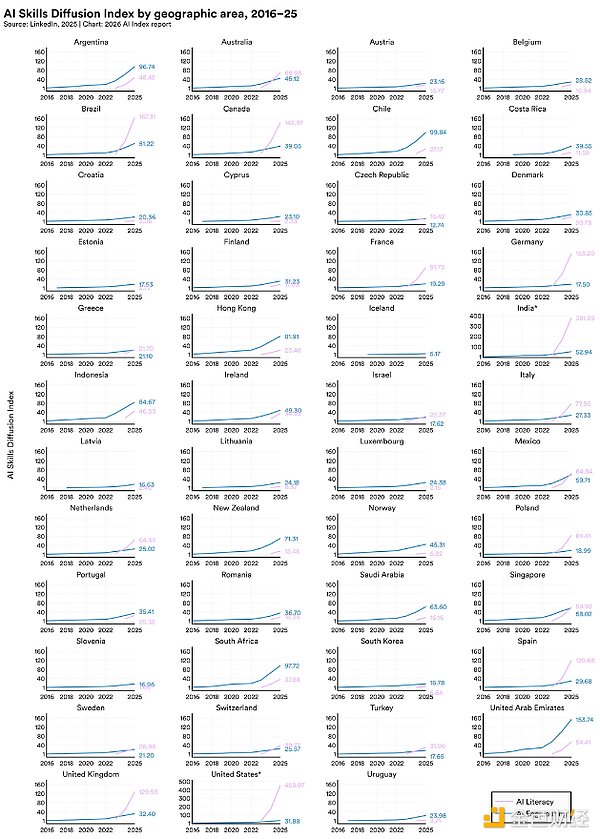

超过80%的美国高中生和大学生在学习任务中使用 AI,但只有一半的中学和高中制定了 AI 政策,且仅有6%的教师认为这些政策清晰明确。在课堂之外,AI 工程技能在阿联酋、智利和南非加速最快。2022至2024年间,美加地区的 AI 博士生人数增长了22%,但这些新增的博士主要选择了学术界而非工业界职位。

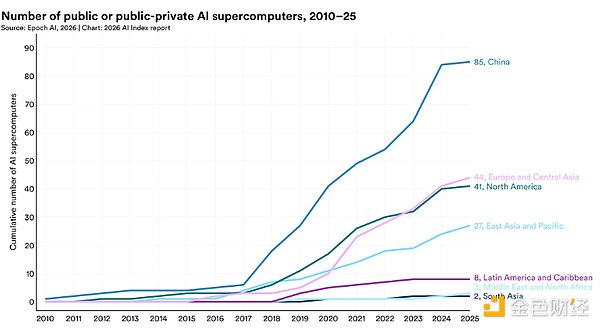

9、AI 主权正成为国家政策的定义性特征,虽然能力分布仍不均衡,但开源开发正助力参与者多元化

各国 AI 战略正在扩张,特别是在发展中经济体,国家背景的 AI 超算投资同步增长,标志着各国对掌控本土 AI 生态系统的野心日益增强。目前模型生产仍集中在中美两国。开源开发正在重塑参与格局,GitHub 上来自世界其他地区的贡献现已超过欧洲,并逼近美国,推动了语言多样化模型和基准的发展。

10、AI 专家与公众对技术的未来看法大相径庭,全球对管理 AI 的机构信任度呈碎片化

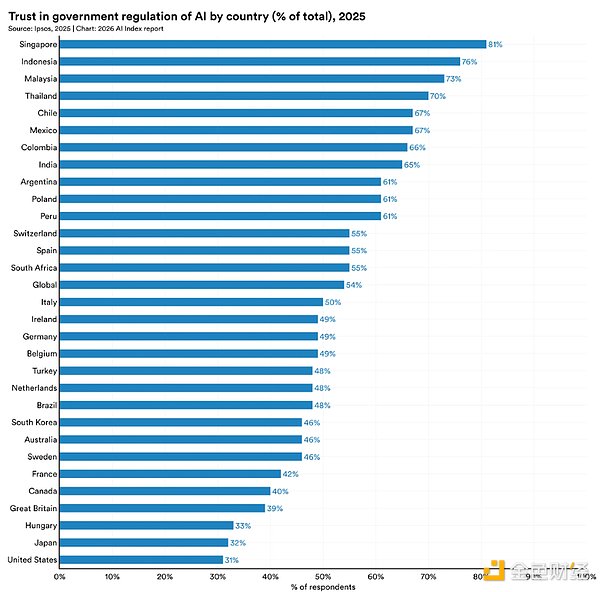

关于 AI 对工作的影响,73%的专家预期会有积极作用,而公众中仅有23%持此观点,差距达50个百分点。在 AI 对经济和医疗的影响方面也存在类似分歧。全球对政府监管 AI 的信任度不一。在受访国家中,美国对其政府监管 AI 的信任度最低,仅为31%。在全球范围内,欧盟在有效监管 AI 方面比美国或中国更受信任。

二、报告解读

1、能力前沿:加速、收敛与"锯齿形"边界

性能突破正在让基准测试过时

2025年,AI能力的提升速度不仅没有放缓,反而在加快。前沿模型在单一年份内于Humanity's Last Exam(专为难倒AI而设计的基准测试)上提升了30个百分点;而SWE-bench Verified(软件工程代码能力测试)从60%飙升至接近100%的人类基线,仅用了一年。

更深刻的问题是:AI的进步速度已经超过了为测量它而设计的基准测试。那些本该在数年内保持挑战性的评估,数月内就被饱和。评估工具失效意味着我们正在失去追踪AI真实进展的仪器。

顶级模型性能高度收敛

按Arena Elo竞技评分,截至2026年3月,Anthropic(1503分)、xAI(1495分)、Google(1494分)、OpenAI(1481分)、阿里巴巴(1449分)和DeepSeek(1424分)聚集于顶端,顶级4家公司仅相差25分。能力本身已不再是差异化竞争维度,竞争压力正在转向成本、可靠性和特定领域性能。

美中AI差距实质性消失

2025年初以来,美中顶级模型在性能排名上多次易位。2025年2月,DeepSeek-R1短暂追平了美国最强模型;截至2026年3月,美国顶级模型的领先优势仅剩2.7%,且在过去一年内持续在个位数区间波动。与此同时,中国在论文发表量、引用量、专利授权数和工业机器人安装量上均领先全球;美国则在顶级模型开发数量(2025年美国50个,中国30个)和高影响力专利上仍占优势。韩国凭借人均AI专利密度位居全球第一,展现出独特的创新活力。

"锯齿形智能":能拿数学奥赛金牌,却看不准时钟

报告提出了"锯齿形前沿"(jagged frontier)这一核心概念。Gemini Deep Think在2025年国际数学奥林匹克竞赛中获得金牌(35分),在4.5小时内全程用自然语言完成解题;然而同款顶级模型在ClockBench上读取模拟时钟的正确率仅为50.1%,而人类达到90.1%。

这种不均衡性在专业领域同样存在:AI模型在税务、抵押贷款处理、企业金融和法律推理的评估中表现在60%至90%之间——前15名模型之间差距不过3个百分点——说明高可靠性专业场景仍是重大挑战。

AI Agent:从12%到66%的大跳跃,但仍有三分之一的失败率

在OSWorld(测试跨操作系统的真实计算机任务)上,AI Agent的准确率从约12%大幅跃升至66.3%,接近人类表现,进步显著。但在结构化基准测试上,Agent仍约三分之一时间告败。机器人领域的"锯齿"更加明显:RLBench软件仿真环境中操控成功率达89.4%,而在真实家庭任务中仅能完成12%。自动驾驶是罕见的例外,已实现规模化部署并呈现出令人鼓舞的安全记录。

2、研发格局:工业主导、透明度下滑、集中度上升

产业界主导前沿,透明度却在倒退

2025年超过90%的值得关注的前沿模型由产业界生产,但能力最强的模型恰恰是最不透明的。OpenAI、Anthropic、Google等多家顶级实验室已停止披露训练代码、参数量、数据集规模和训练时长。Foundation Model透明度指数的平均分从2024年的58分骤降至2025年的40分。"越强越秘密"的趋势,让独立评估和安全研究面临前所未有的障碍。

算力:3.3倍的年增速与单点脆弱性

全球AI算力自2022年以来每年增长3.3倍,2025年达1710万H100等效算力。英伟达占据60%以上份额,谷歌和亚马逊提供大部分其余部分,华为则占据小但不断增长的份额。

然而这一庞大体系存在一个致命的单点依赖:几乎所有顶级AI芯片都由台积电(TSMC)一家代工厂制造,使全球AI硬件供应链极度依赖台湾。2025年台积电美国工厂开始运营,但这一结构性风险短期内无法消除。美国拥有5427个数据中心,超过排名第二国家的10倍,但其能耗也同样居全球首位。

环境代价:数字已触目惊心

AI的环境足迹随其能力同步扩张。Grok 4的训练预估排放量达72816吨CO₂当量;AI数据中心总功率容量升至29.6吉瓦,相当于纽约州峰值用电需求;仅GPT-4o推理一项,年耗水量可能超过1200万人的饮水需求。

3、经济影响:投资暴增、生产率可见,就业影响初现

全球AI投资超历史记录

2025年,全球企业AI投资超过翻倍,私人投资增速高达127.5%,占总量60%。生成式AI增长超过200%,吸引了近一半私人AI融资。美国私人AI投资达2859亿美元,是中国的23倍;新获融资AI公司达1953家,是排名第二的国家的10倍以上。

消费者价值与采用速度双创纪录

生成式AI在三年内实现53%的全球人口采用率,速度超过个人电脑和互联网。美国消费者从生成式AI工具获得的年度估算经济价值在2026年初达到1720亿美元(2025年为1120亿美元),中位数用户价值一年内翻了三倍,而绝大多数工具仍然免费或接近免费。

企业层面,88%的受调查组织已采用AI,中国和欧洲增速最快;70%的组织在至少一项业务功能中使用生成式AI。但AI Agent在几乎所有业务功能中的部署仍处于个位数阶段。

值得注意的是,尽管美国主导了AI投资和模型开发,其生成式AI采用率却仅28.3%,在全球排名第24位;而新加坡(61%)和阿联酋(54%)的采用率远超其GDP水平所预测的值。

劳动力:生产率红利与就业隐忧同步显现

研究显示AI带来的生产率提升集中于可量化的结构性工作:客户支持提升14-15%、软件开发提升26%、营销产出提升50%;在需要更深层判断的任务中,效果减弱甚至为负。

与此同时,就业影响的早期信号已经出现,且高度集中于最年轻的工作者。美国22至25岁软件开发人员就业人数从2024年下降了近20%,而年龄较大的开发人员数量仍在增长。三分之一受调查组织预计在未来一年缩减人员,但这一预期变化在整体就业数据中尚未大规模体现。报告还发现一个令人警惕的长期效应:过度依赖AI可能带来学习惩罚,减缓人类技能的长期积累。

4、负责任AI:事故激增,安全与能力的矛盾无解

2025年,记录在案的AI事故数量上升至362起,相较2024年的233起增加了55%。与此同时,能力基准测试受到普遍测试,但负责任AI基准测试的报告参与率依然稀疏。

更深层的挑战是:提升某一负责任AI维度往往会降低另一维度。训练旨在提高安全性的技术会一致性地损害准确性,反之亦然。这一实证发现意味着"安全且准确的AI"并非简单的工程问题。

在幻觉与可靠性上,26个顶级模型的幻觉率从22%到94%不等,跨度触目惊心。当虚假陈述被包装为"另一个人的信念"时,模型表现良好;但当同样的虚假陈述被呈现为"用户自己的信念"时,性能骤然崩溃——模型尚不能可靠区分知识与信念。

在对抗性攻击下,多个前沿模型在AILuminate基准测试的标准场景中获得"非常好"或"良好"的安全评级;但面对精心设计的越狱提示,所有被测模型的安全性能均出现下降。

5、科学与医学:潜力巨大,证据体系仍然薄弱

科学领域:局部突破,全局复现率偏低

AI在科学领域的出版物年增26%,占2025年全部科学研究产出的5.8%至8.8%。顶级模型在ChemBench上对化学问题的平均表现超越了人类化学家,但同时在基础任务上频频失误;在ReplicationBench天体物理复现测试中得分低于20%;Earth观测问答准确率仅33%,代码失败率高达58%。

一个引人注目的反直觉发现是:小模型正在击败大模型。1.11亿参数的MSAPairformer在ProteinGym蛋白质预测基准上击败了此前所有方法;2亿参数的GPN-Star基因组模型击败了参数量近200倍的竞争者。科学领域AI模型的开发主要来自学术机构和跨机构合作,与通用AI的产业主导格局截然不同。

医学领域:自动病历成功落地,临床证据基础薄弱

2025年,自动生成临床病历工具获得大规模应用,多个医院系统的医生反映写病历时间减少达83%,职业倦怠显著降低。然而,对500余项临床AI研究的综述发现:近一半研究依赖考试题型而非真实患者数据,仅5%使用了真实临床数据。临床AI工具在落地层面领先,但支撑其可信度的证据体系远未成熟。

6、教育与人才:使用先于政策,博士增长流向学界

美国高中和大学生中超过80%使用AI完成学业相关任务,但只有一半中学具备AI政策,仅6%的教师认为这些政策表述清晰。中国和阿联酋已于2025-2026学年开始强制推行AI教育,代表着全国性AI素养培育的结构性转变。

在人才培养层面,2022年至2024年间,美国和加拿大新增AI博士数量增加了22%,但增量部分全部流向学术岗位,而非产业界——逆转了过去十年AI博士持续向产业倾斜的趋势。与此同时,AI研究人员和开发者迁入美国的数量自2017年以来下降了89%,仅过去一年就下降了80%,美国对顶级AI人才的吸引力正在显著衰减。

7、政策、治理与公众认知:信任撕裂,主权竞赛开始

立法加速,但监管仍追不上AI落地速度

各国AI治理策略持续扩充,尤其是发展中经济体正在加速布局。各国对AI超级计算的国家投资也在同步上升——国家主权AI的雄心正从言辞转向基础设施。但模型生产仍高度集中于美中两国;开源开发正在重新分配参与权,来自世界其他地区的GitHub贡献量已超过欧洲,并接近美国,推动了更多语言多样性的模型和基准测试。

专家与公众的认知鸿沟:50个百分点

关于AI对工作的影响,73%的专家预期正面效果,而公众中只有23%持相同看法——差距高达50个百分点。类似的鸿沟在经济影响和医疗效果的问题上同样存在。

在对政府监管AI的信任度方面,美国在受调查国家中排名垫底,仅31%的受访者信任本国政府能够有效监管AI。全球范围内,欧盟的监管可信度评分高于美国和中国。

三、结语

2026年斯坦福AI指数报告揭示的核心张力,是能力曲线与治理曲线之间持续扩大的剪刀差。

AI在编码、数学、科学推理、医疗辅助、气候预测等领域创造了真实可量化的价值,正以前所未有的速度渗透进企业、学校、医院和政策制定机构。

然而,让我们真正能够理解、衡量、引导这种渗透的基础设施——评估基准、监管框架、教育政策、透明度机制——正在力不从心。

报告没有对AI的未来给出乐观或悲观的裁决,它提供的是一套精准的测量仪器,告诉我们这场技术变革在哪些维度上超出了人类的预期,又在哪些维度上暴露了我们准备不足的真实代价。

声明:本文系金色财经原创稿件,版权属金色财经所有,未经授权不得转载,已经协议授权的媒体下载使用时须注明"稿件来源:金色财经",违者将依法追究责任。

提示:投资有风险,入市须谨慎。本资讯不作为投资理财建议。

24小时热文

关于Claude严防中国用户的一点忧虑和建议

关于Claude严防中国用户的一点忧虑和建议孟岩的区块链思考

金色Web3.0日报 | 美国称有望与伊朗达成协议

金色Web3.0日报 | 美国称有望与伊朗达成协议金色财经 善欧巴

Anthropic最新模型Opus4.7的8把Hidden Blades

Anthropic最新模型Opus4.7的8把Hidden BladesGenAI Summit

巨鲸疯狂增持 能否助推BTC迎来突破?

巨鲸疯狂增持 能否助推BTC迎来突破?区块链骑士

一文读懂代币化的关键问题

一文读懂代币化的关键问题ChainCatcher

加密溢价的终结?从Gemini上市后困境看市场逻辑转变

加密溢价的终结?从Gemini上市后困境看市场逻辑转变链捕手ChainCatcher

2026香港Web3嘉年华参会指南

2026香港Web3嘉年华参会指南金色财经

当人们反对AI 他们究竟在反对什么?

当人们反对AI 他们究竟在反对什么?金色财经

- 寻求报道

金色财经APPiOS & Android

金色财经APPiOS & Android- 加入社群

Telegram - 意见反馈

- 返回顶部

- 返回底部